Overview

Omni-R1: Reinforcement Learning for Omnimodal Reasoning via Two-System Collaboration

https://arxiv.org/abs/2505.20256

这里 训练系统1 的时候,为什么最先想到的是 sft, 虽然最后被否决了?

SFT的逻辑为 “给模型看大量‘输入→正确输出’的例子,让它学会模仿”,对于 System 1,输入是 “长视频 + 全局指令”,输出是 “关键段选择 + 局部指令”,这看起来就是一个典型的序列到序列(seq2seq)生成任务,完全符合 SFT 的应用范式

从 ChatGPT 到 LLaMA、Qwen 等开源模型,几乎所有主流大模型的对齐流程都是:

预训练 → SFT(指令微调) → 强化学习(RLHF/GRPO 等)

SFT 是必经之路,它能快速让模型学会 “遵循指令”

System 1 的分层奖励设计 没有 将 最终任务目标(如分割 mIoU)作为唯一奖励;那么什么时候可以用端到端训练

端到端训练的核心前提是:从输入到最终输出的整个链路是可微分的,并且存在明确的监督信号。满足这两个条件,就可以用一个统一的损失函数(如交叉熵、IoU、MSE)直接训练所有参数

并且 有明确的 “输入 - 输出” 监督对;如 分类任务有 “图像 - 类别标签” 对;这些标注提供了直接的监督信号,模型可以通过梯度下降,自动学习到 “如何从输入得到正确输出” 的中间表示,不需要显式设计中间步骤的奖励

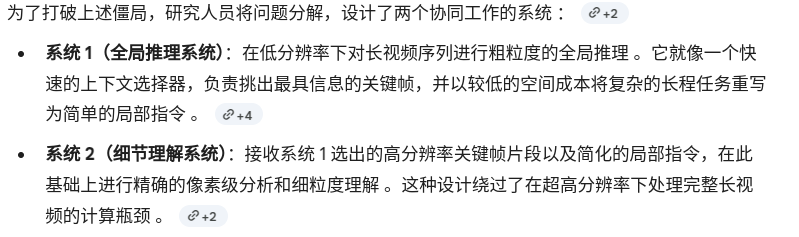

主要框架

痛点

解决方案:双系统协作架构 (Two-System Architecture)

Omni-R1 强化学习训练框架

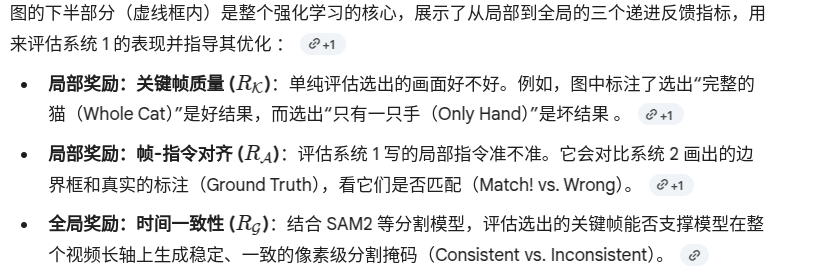

由于很难人工定义或监督什么是“最优”的关键帧选择和任务重写,研究团队将系统 1 的优化过程转化为一个强化学习问题

sys1

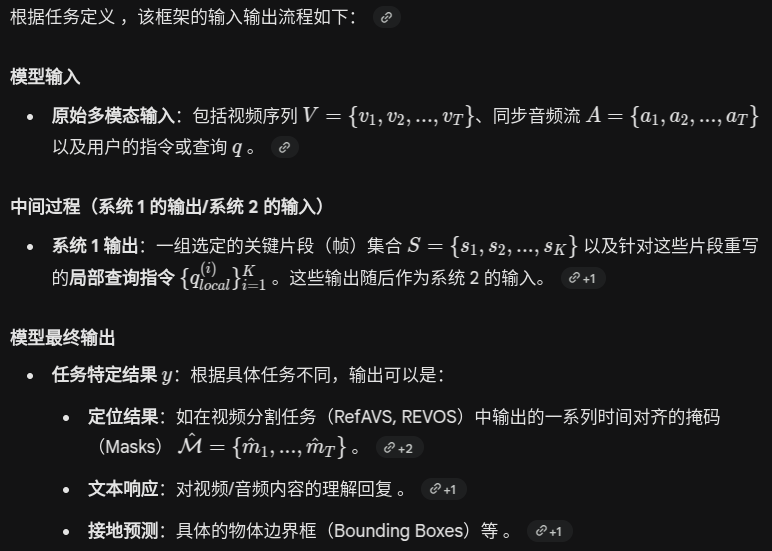

任务输入与系统 1 推理 (Global Reasoning System)

系统 2 细节理解 (Detail Understanding System)

层次化奖励机制 (Hierarchical Rewards Feedback)

GRPO 策略更新

如何理解“系统一和系统二是强耦合的”这句话?

NitroGen: An Open Foundation Model for Generalist Gaming Agents

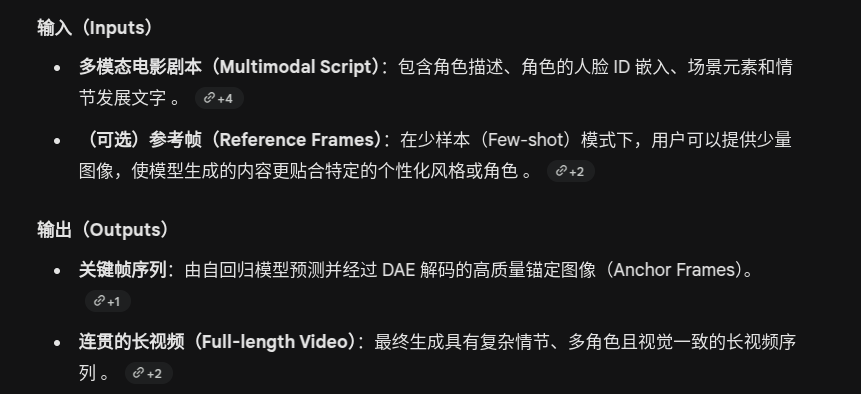

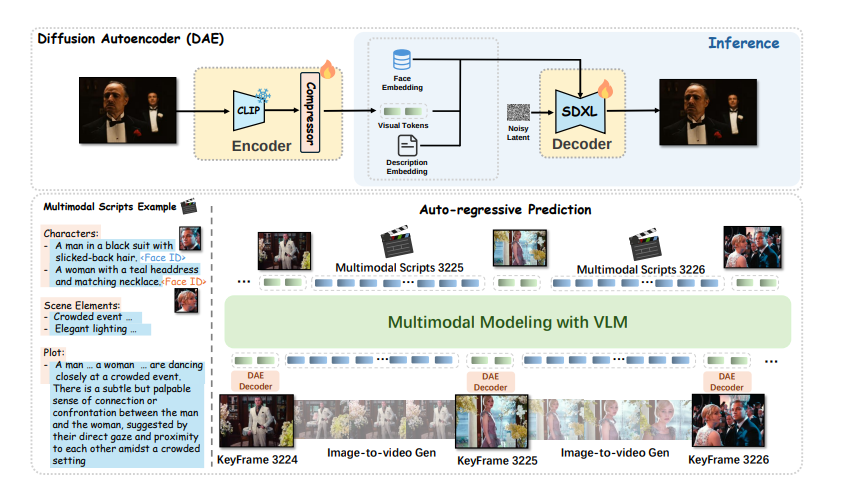

MOVIEDREAMER: HIERARCHICAL GENERATION FOR COHERENT LONG VISUAL SEQUENCES

Sora 相对于传统视频生成模型

采用时空Transformer,同时对空间维度(捕捉单帧图像内部的视觉特征)和时间维度(捕捉帧与帧之间的时序关联)进行建模;

Scaling Law

Diffusion Autoencoder 和 传统扩散模型 的区别(2022版本,还没用transformer)

核心架构

能做到什么?

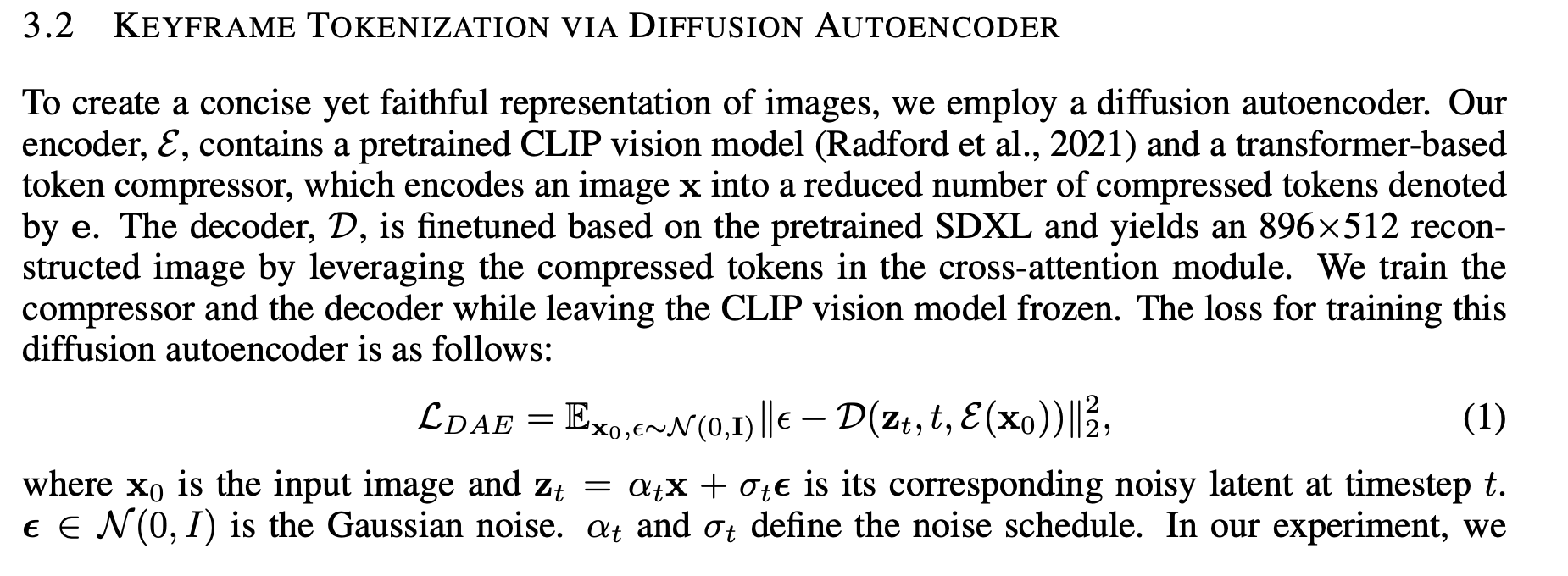

论文中diffusion autoencoder核心架构

MovieDreamer存在有图模式和无图模式,如果没有图片输入的话, 那 clip 和 compressor不就没活可干了?另外,连基础样品都没,还怎么做后续的自回归预测 图像token?

在纯剧本生成视频的场景下,它们的作用体现在“定义的空间”和“训练阶段”:

它们定义了“语言”:Compressor 的存在,是为了给 LLM(如 LLaMA)定义一套“视觉单词表”。即使推理时没给图片,LLM 预测出的那 2 个数字(Token)也必须落在 Compressor 训练好的那个特征空间里。

训练时的“老师”:在训练阶段,模型看了数百万个视频。CLIP 和 Compressor 负责把视频变成 Token 教给 LLM。到了推理时,LLM 实际上是在“背诵”或“模仿”它见过的图像 Token 序列。

CLIP

训练方式:对比学习

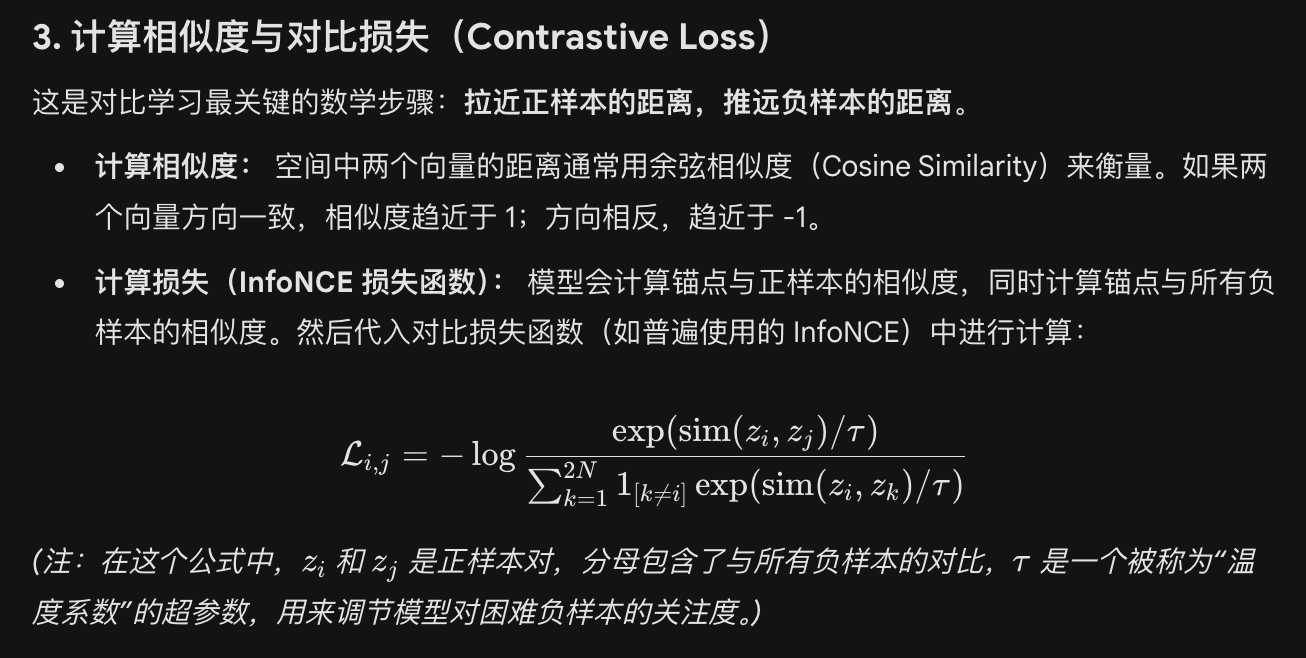

训练细节

内部结构

意义

卷积神经网络

组成

强大之处

输入

输出(常见的)

卷积核是如何在矩阵中提取特征的?

具体动作

为什么乘加运算 就能提取特征?

more

transformer based token compressor 是什么

什么是token?

为什么需要压缩(compressor)?

为什么是基于 Transformer?

在本论文中 Q K V 是什么?

本文的 diffusion autoencoder 和原始版本有相差,原始版本的 zsem, 而SDXL的输入特殊,他接受一系列token;因此在这里 CLIP和 transformer压缩器将原始图像 压缩成一组序列token e;

为什么要冻结 CLIP?是因为CLIP的输出到 compressor之间 无法用链式法则来更新CLIP的参数吗?

防止灾难性遗忘;节省算力

SDXL(Stable Diffusion XL)其输入输出

输入端

内部程序

输出

SDXL在训练过程中其输入输出

原始数据

核心网络 (U-Net) 的输入端 (Inputs)

核心网络 (U-Net) 的输出端 (Outputs)

Loss 闭环学习

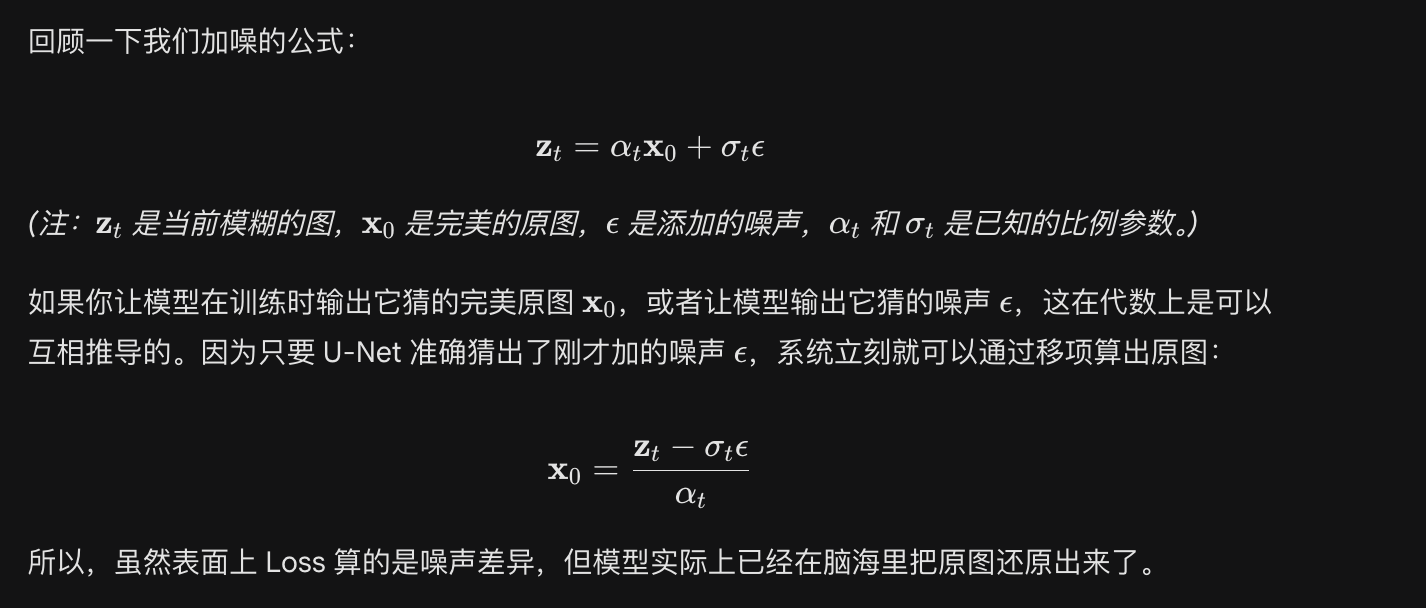

在 SDXL 训练的过程中,是以 预测的噪声 和 实际的噪声 的 差异 来计算loss的;但我在看那些普通的 MLP的分类器中,都是拿最终实际得出的分类结果进行softmax 再和 预期结果做比较算loss的;也就是说,MLP分类器的 训练 和 实际使用 的 结果 都是 分类结果;而这里 SDXL 训练中的 LOSS却是噪声,而实际使用中却要还原出图像;为何要用噪声当loss训练呢?

SDXL 在 使用过程中,往往要输入 一个完全 随机 的 噪声图和 一段文本描述转换而成的 token;既然是完全随机的,那为什么要加这个噪声图呢?这和训练 过程中 输入为 原本的图像加一个噪声,然后去预测这个噪声是什么,这个过程有什么关系?

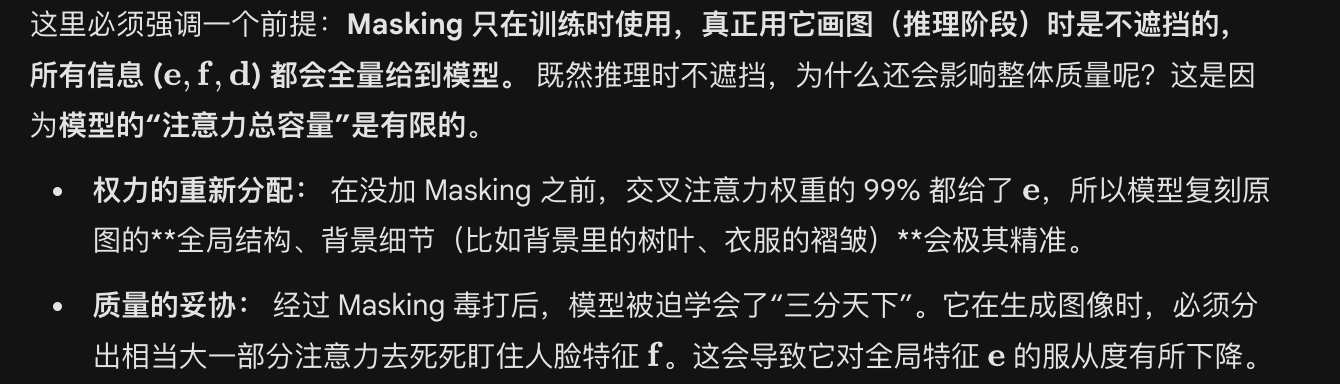

选择用masking;是不是在舍弃一小部分 训练收敛速度 和 最终模型生成图形质量 的情况下,换取 对脸部细节的 更精密生成?

“This involves parameterizing the GMM with kd means, kd variances, and k mixing coefficients.” kd 个均值(Means)、kd 个方差(Variances)以及 k 个混合系数 具体是什么?

变量含义

具体含义

交叉熵的离散输出不再适用生成图像的训练

交叉熵损失函数如是计算分数 (ytrue是真实答案的概率, ypred是模型预测的概率,真实答案的概率为独热码分布,只有一项是0;因此在LLM输出结果中, 香蕉 和 汽车 相对于 苹果的正确度是一样的,尽管有水果这个共同特征;但是在模型内部,还是能意识到两者关系的)

Loss = -Σ(ytrue * log(ypred))

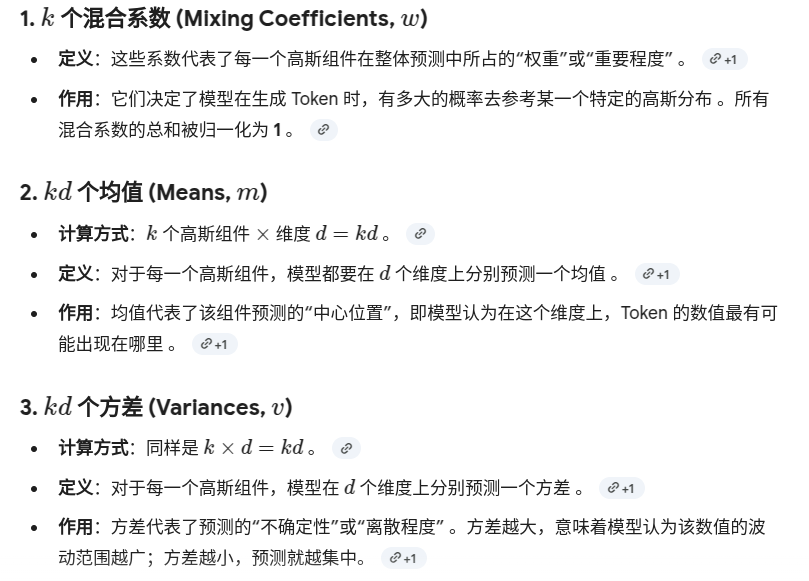

自回归

H<t即过去的经验, 根据过去的经验,外加剧本提示Mt, 在此条件下 计算p,即正确答案在 生成的概率分布 中的概率;

前面的 CLIP,compressor, decoder 训练 根据token生成图像,这里训练生成token

既然 人脸嵌入主要由 FARL 模型提取,并且FARL在训练中是冻结的,并且 FARL的输入只包含面部区域,那么案例来说输出的嵌入结果只和这个人有关啊,为什么还要防止和 场景信息有耦合呢?

MLP的内部神经网络架构长什么样

宏观层级结构 (Layer Structure)

神经元之间的连接 (Connections)

微观:单个神经元内部的数学魔法

数据的流动 (Data Flow)

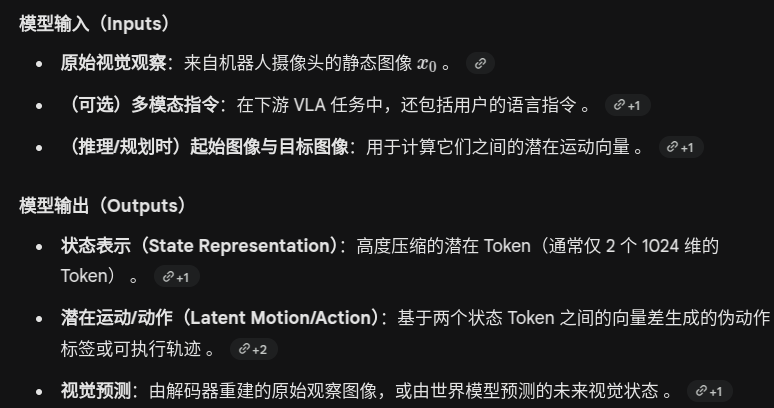

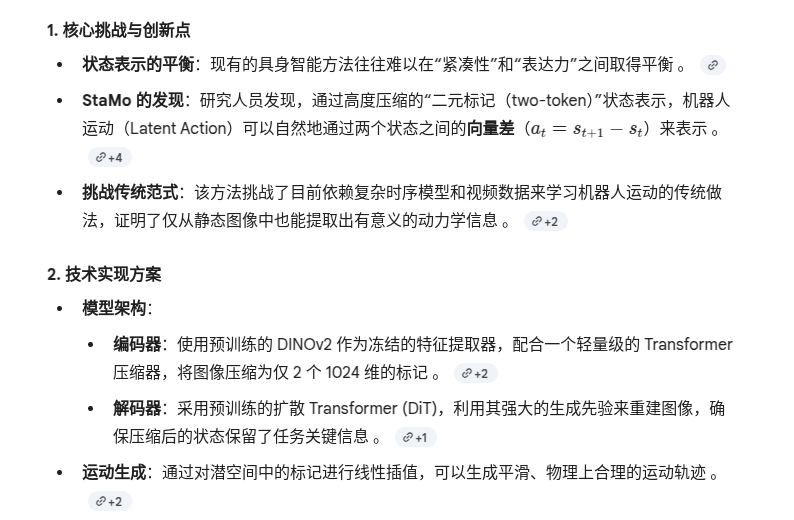

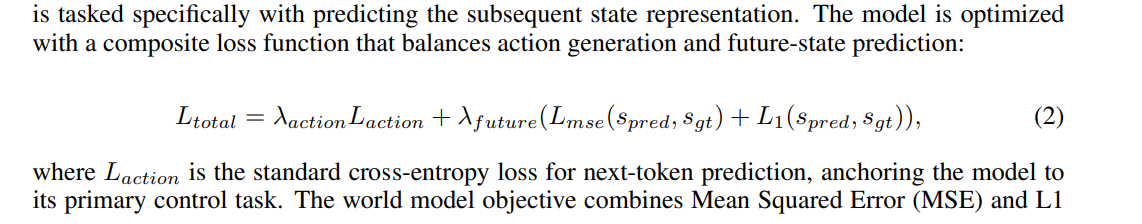

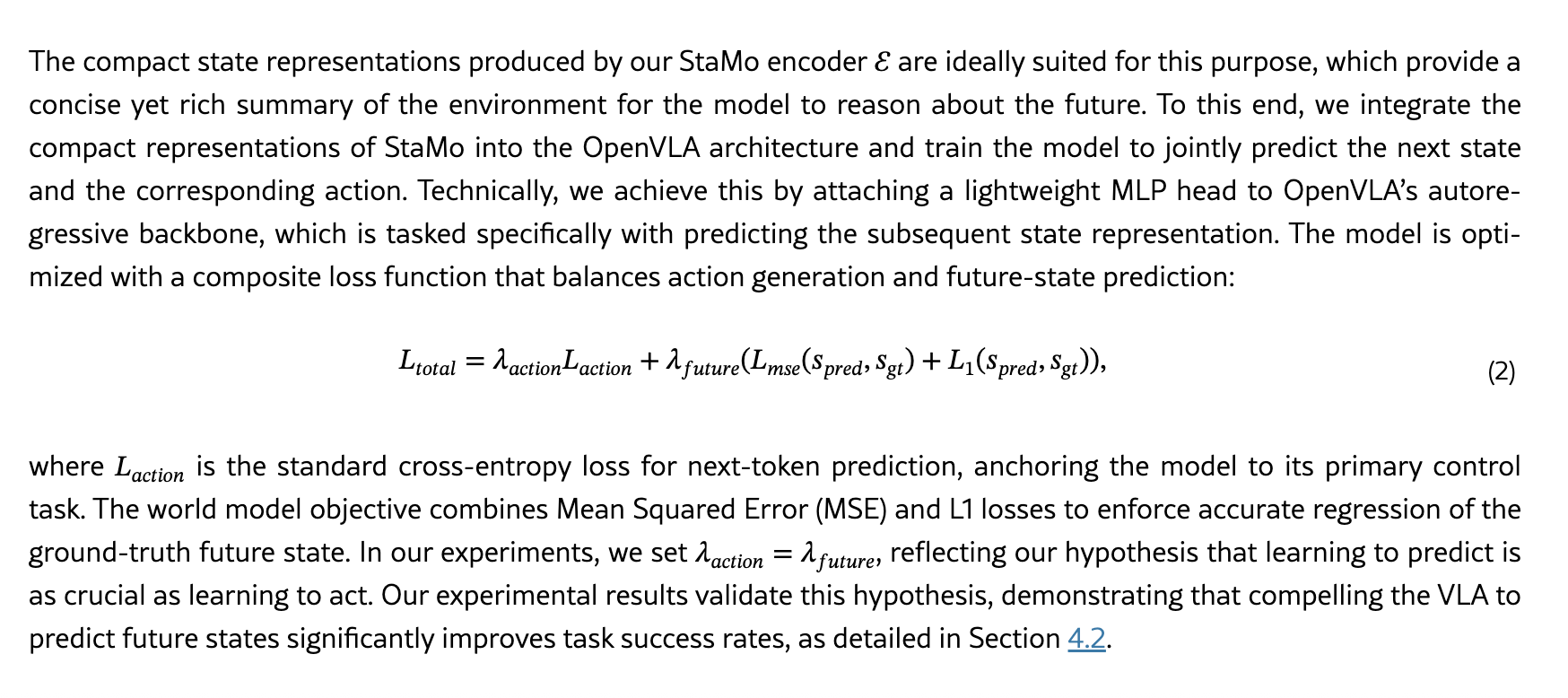

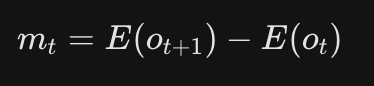

Stamo

https://arxiv.org/html/2510.05057v1

Summary

框架

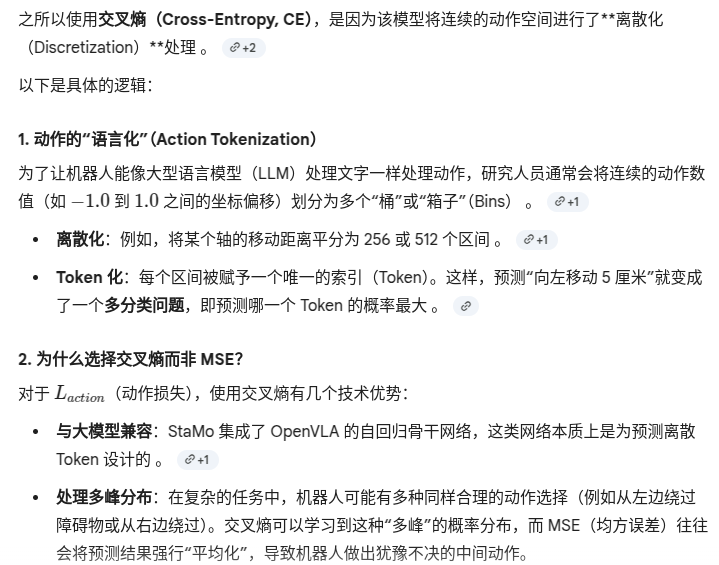

动作的方向距离不是连续的吗?为什么要使用交叉熵?

DiT

之前 SDXL 去噪用的是 U-Net,他内部用CNN,擅长处理局部细节,难以看清全局信息 (两者都在 VAE 进行编码解码,网络在编码后进行处理)

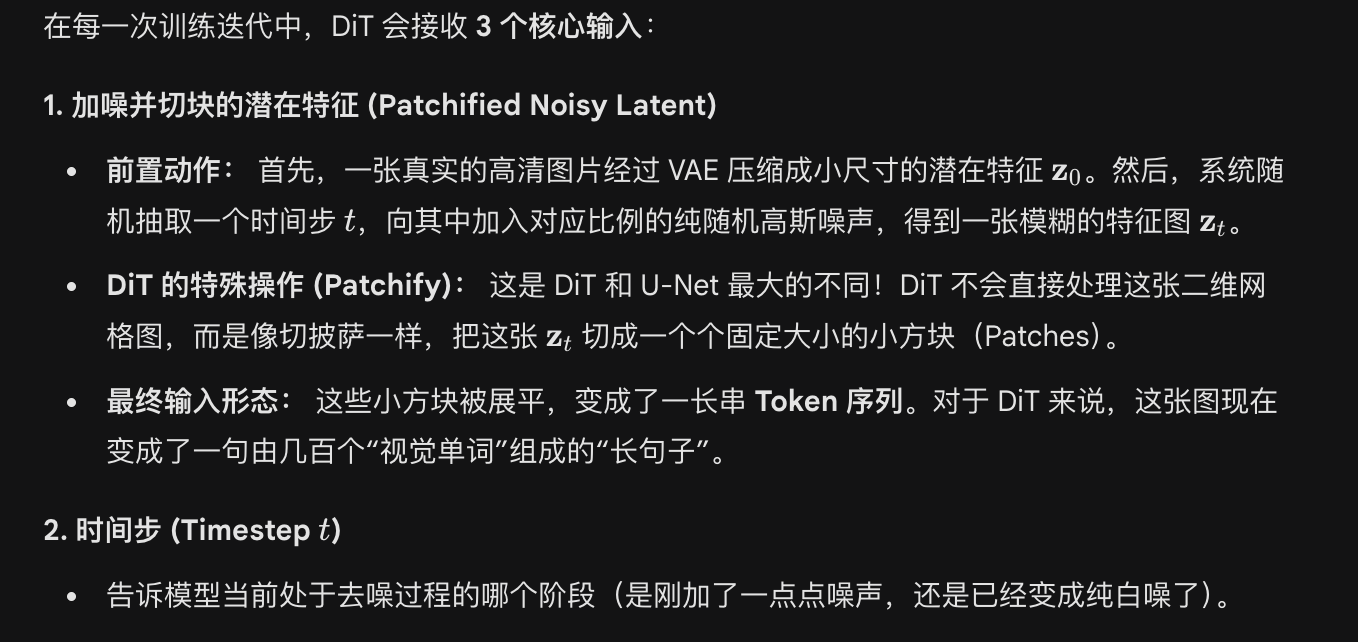

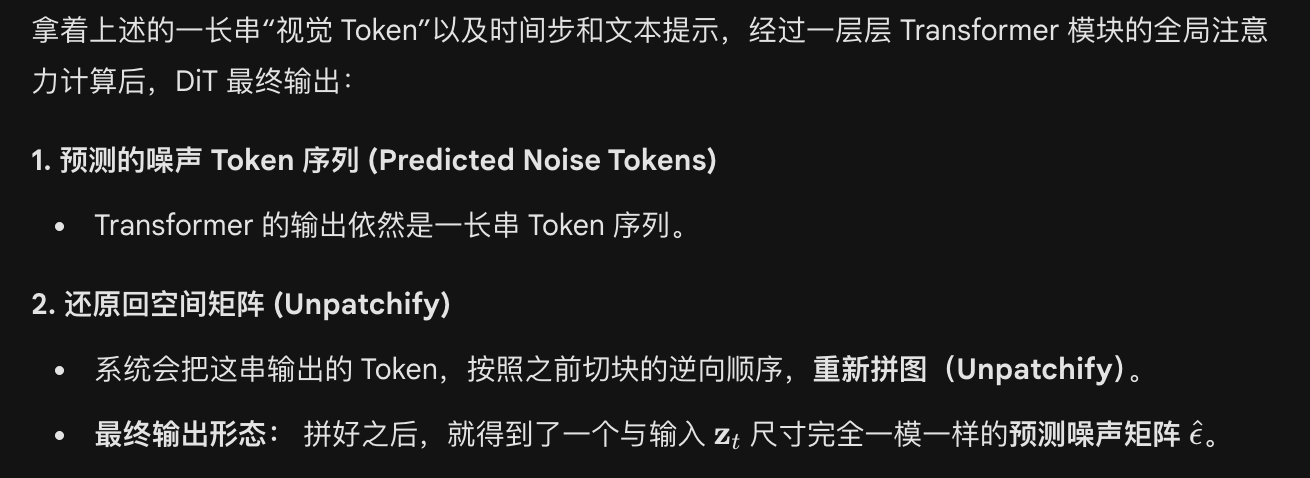

DiT训练时的输入输出

输入端

输出端

we can generate smooth, plausible, and dynamically consistent motion trajectories最终目的

DiT是如何做注意力的?

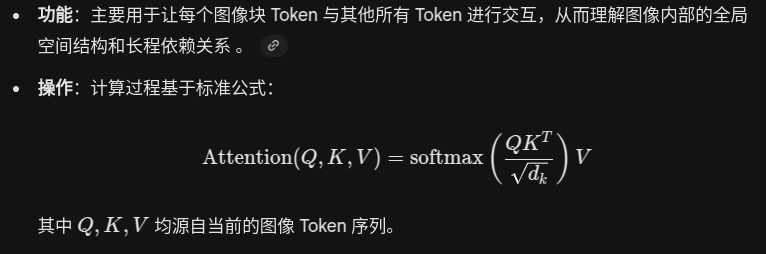

自注意力(Self-Attention)—— 捕捉空间关系

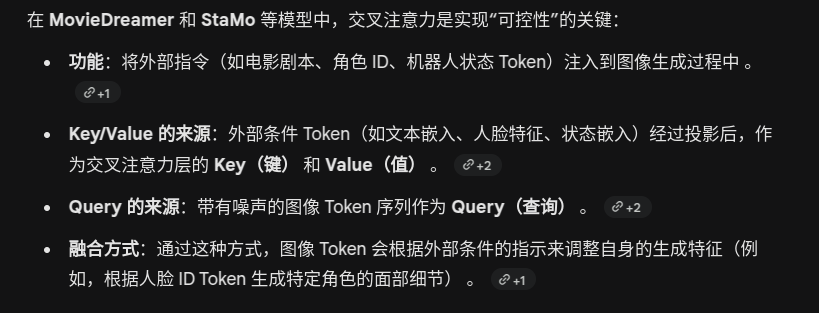

交叉注意力(Cross-Attention)—— 注入外部条件

Variational Autoencoder(VAE, 变分自编码器)

普通的 AutoEncoder是一个两头大、中间小的沙漏型神经网络;但他的隐空间是离散的、不连续的,如果你强行在隐空间里随机生成一个点丢给解码器,它大概率会输出一团乱码。

编码器 不会将一个图片处理成 若干个确定的数字,而是输出一组均值 和 方差

然后,系统会在概率云中随机抽取一个点

解码器拿到这个点,并把它还原成原图

两个损失函数

VAE 在 Sora 和 Stable Diffusion 中的作用

直接在 几十万像素的图片上加噪声和去噪 计算量过大

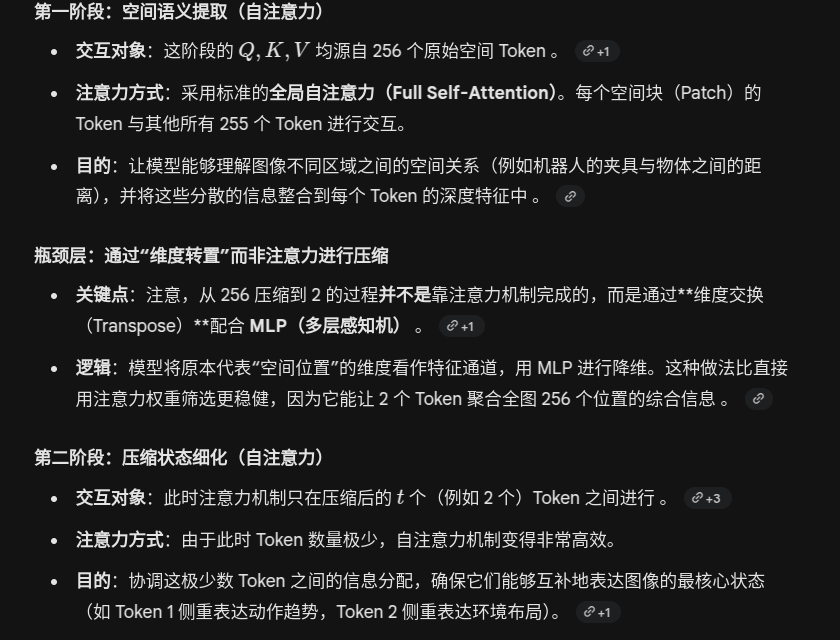

“基于 Transformer 的压缩器”,他的架构是怎样的,是如何做注意力的

压缩器总体架构

注意力机制的工作方式

论文提出问题,对于大方差动作的学习,如果采用MSE 训练的话容易陷入均值回归,那么为何不采用dp策略?

dp输出连续,不适合与LLM相接;而前者输出两个token,适合LLM;前者算力需求低

VAE不将图片压缩成一个点,而是一个概率云

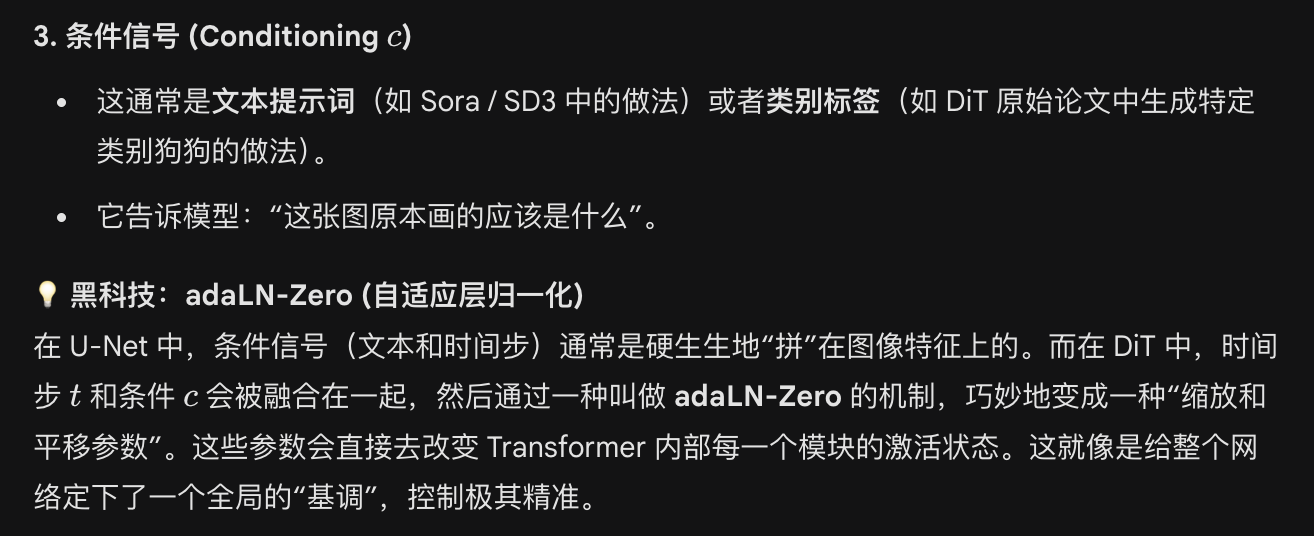

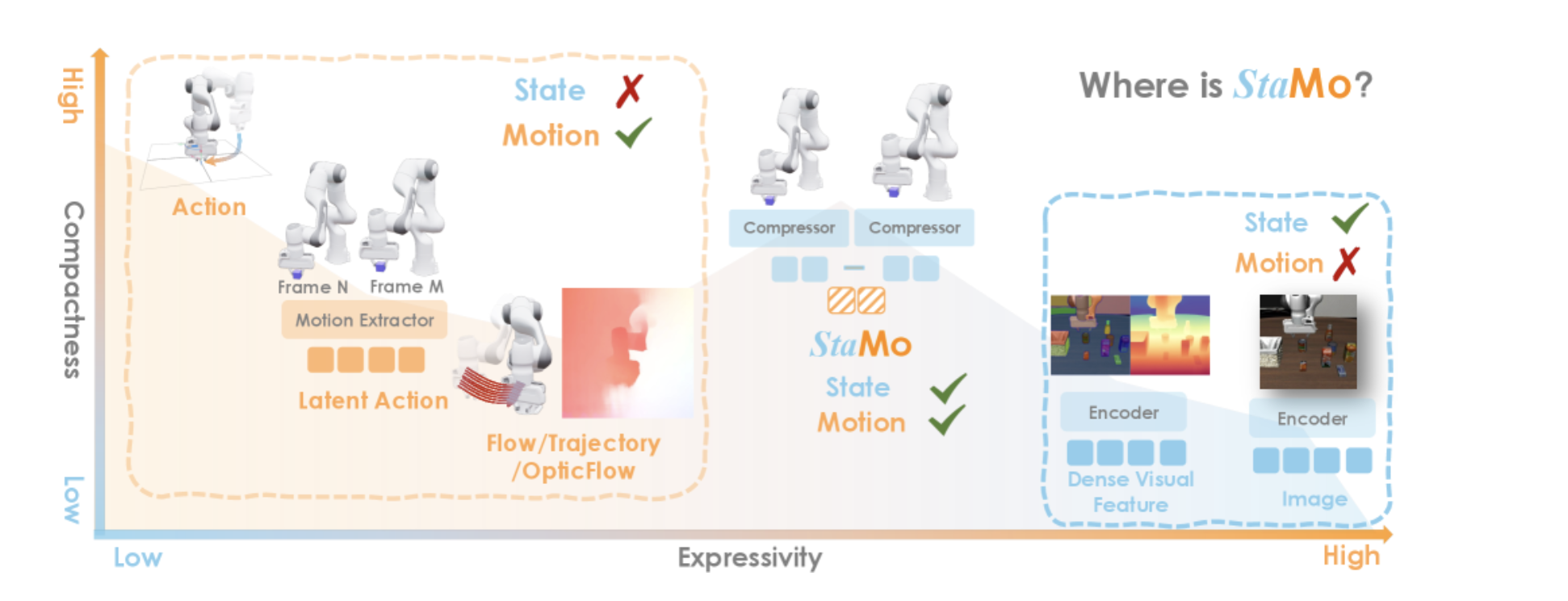

Where is Stamo?(figure)

X轴的“表现力”,表示数据有多丰富;Y轴的 “紧凑型”,表示数据的紧凑性,高紧凑型往往表示 数据维度低。

Flow Matching

传统扩散模型使用 随机微分方程,并且是根据不同时间步向里面加入随机噪声的;而flow matching在数学上定义了“向量场”,用较少的步骤就能生成清晰图片;

是如何用 mlp 将 大模型输出 转化为 连续数值的?

大模型输出原本是离散的

例如Llama 有32000 个词汇token,大模型最后一层输出的就是 一个 32000 长度的数组(打分),然后通过softmax将其和变为100%;VLA 的动作也如同词汇token,被离散化

如何化为连续数值

我们将大模型最后一步 查词汇表给删除,这是其输出是一个隐藏向量,例如有4096维;然后将其送入MLP,进行线性加权求和(wx+b)

如果我们要预测的未来状态 是 2048维的话,那么我们就设计一个MLP,将4096维压缩至2048维

论文中解决有标注的数据量太少的问题

E 即 Stamo压缩器,o为图像,相减得出 潜在运动m;

将 带真实物理动作标签的机器人数据,和带有 StaMo 生成的伪动作标签的视频数据 同时给policy训练

为什么需要 Action Linear Probing Experiment来证明 z_t 包含了有效的动作信息? 混合数据能训练出更好的 模型这一点 还不够有说服力吗?

如果把 Stamo压缩差值,Pooled Delta Image,Delta DINOv2 Features分别拿出去做 端到端训练的话,下游模型可能弥补特征的缺陷,使得模型能力相差没有那么明显

而使用轻量级MLP来进行线性探测,如果结果相差较大,则可以说明 Stamo 压缩差值 对应的 动作特征比较明显。

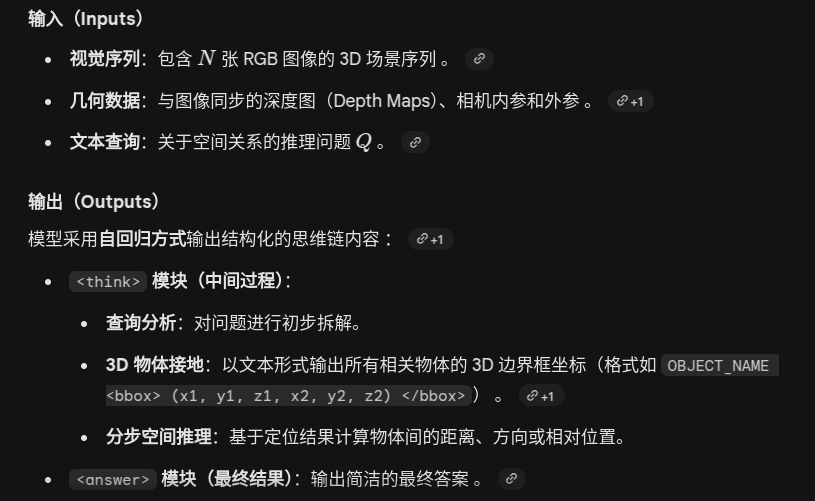

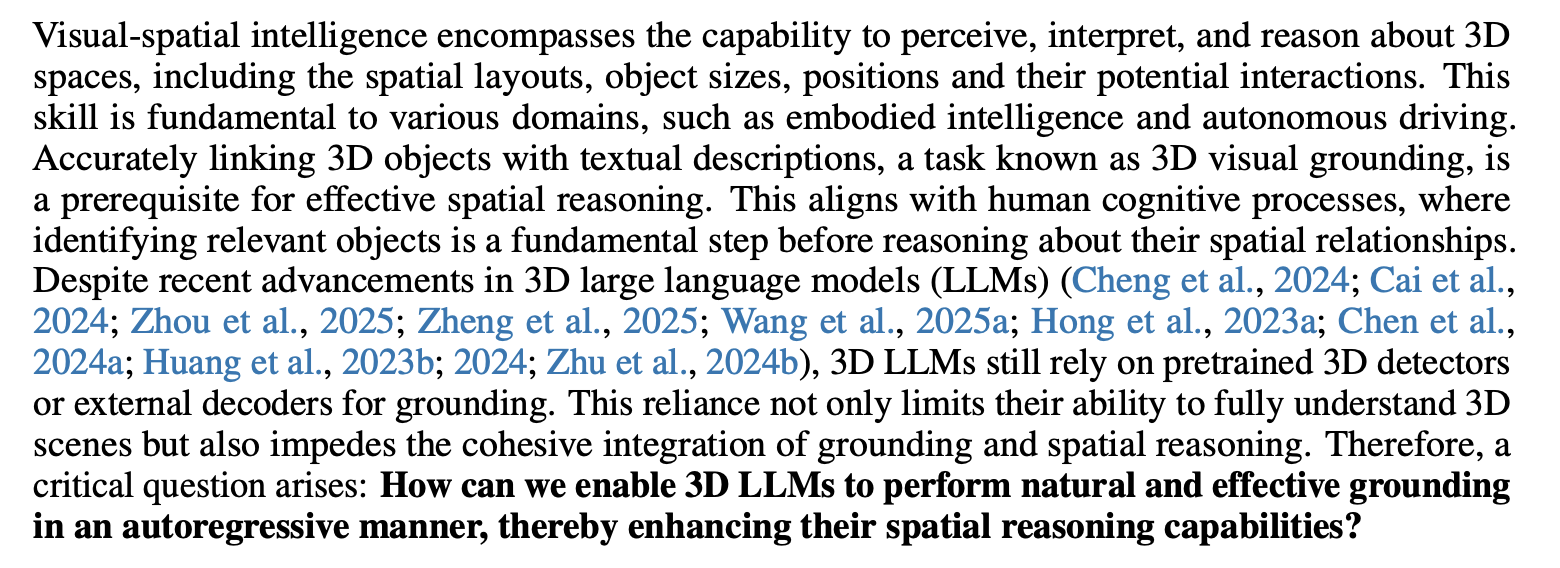

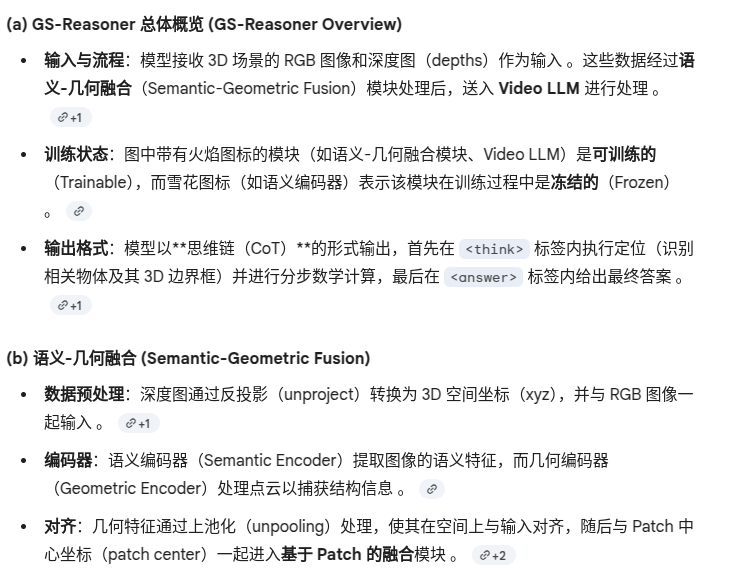

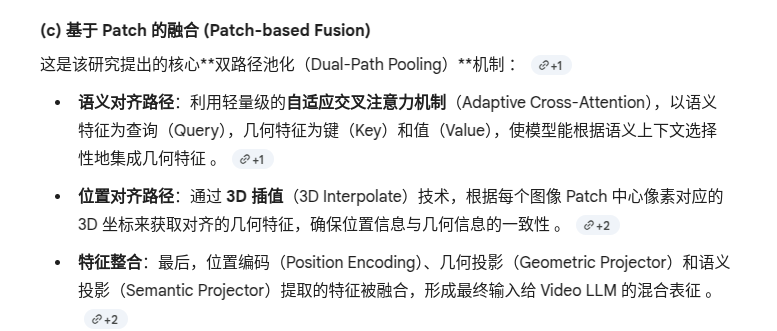

REASONING IN SPACE VIA GROUNDING IN THE WORLD

https://arxiv.org/pdf/2510.13800

看到这里,我不禁疑惑,为什么不把 external decoders 融入到 llm形成一个新的 能grounding 的 llm呢?是因为 这样会破坏原有结构,使得普通 对话性能下降吗?

是的,一点是灾难性遗忘,另一点是 物理坐标 是连续的,llm预测是离散的

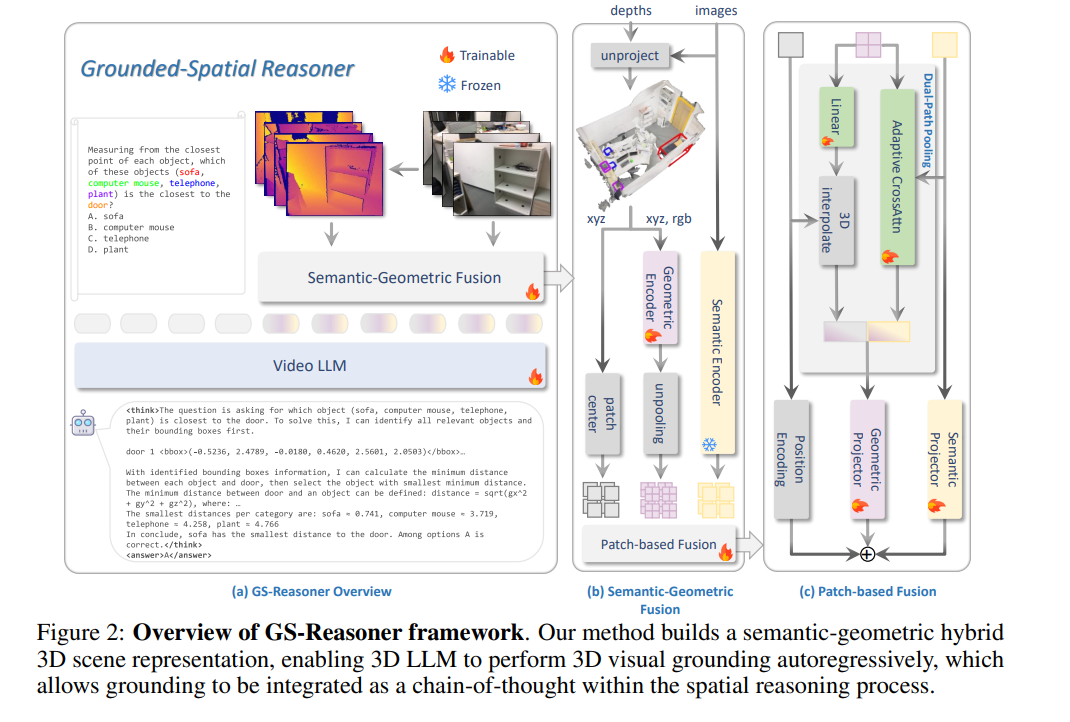

framework

Grounding 一词的含义

3D Visual Grounding,3D 视觉定位/视觉基准化

在这篇论文的语境下,Grounding 具体指的是:当用户用自然语言提到某个物体时,AI 能够准确地在 3D 空间中找出那个物体,并用一个“3D 边界框(3D bounding box)”把它框出来。

为何点云 不具有绝对物理坐标信息?

打乱顺序的点云 输入 普通神经网络 会造成大相径庭的结果

最大池化引出

最大池化

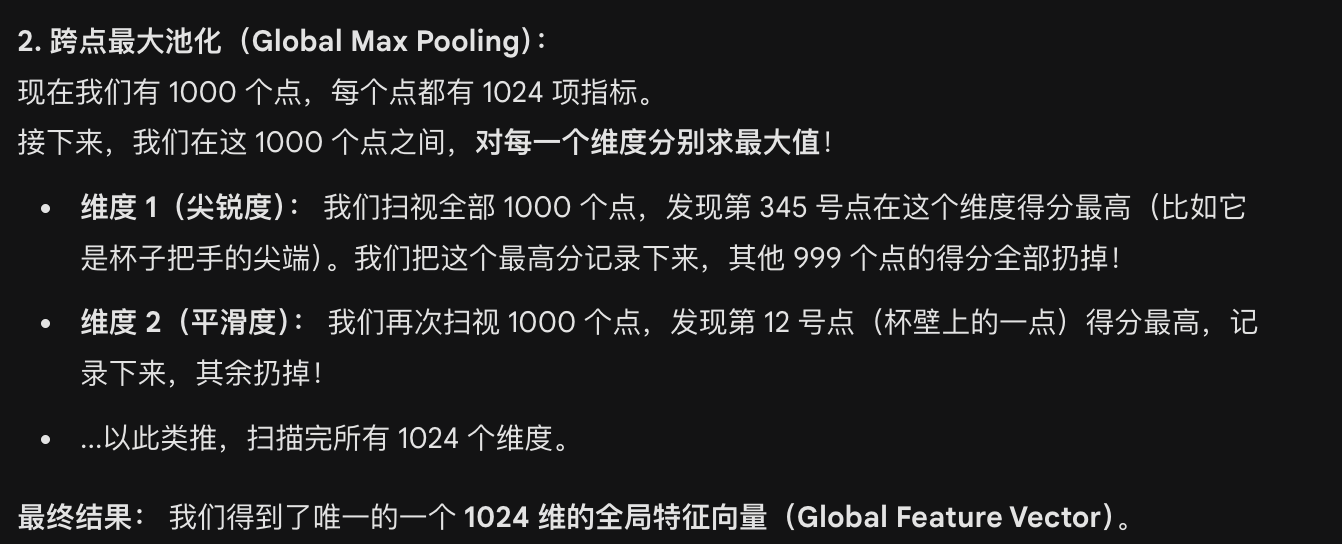

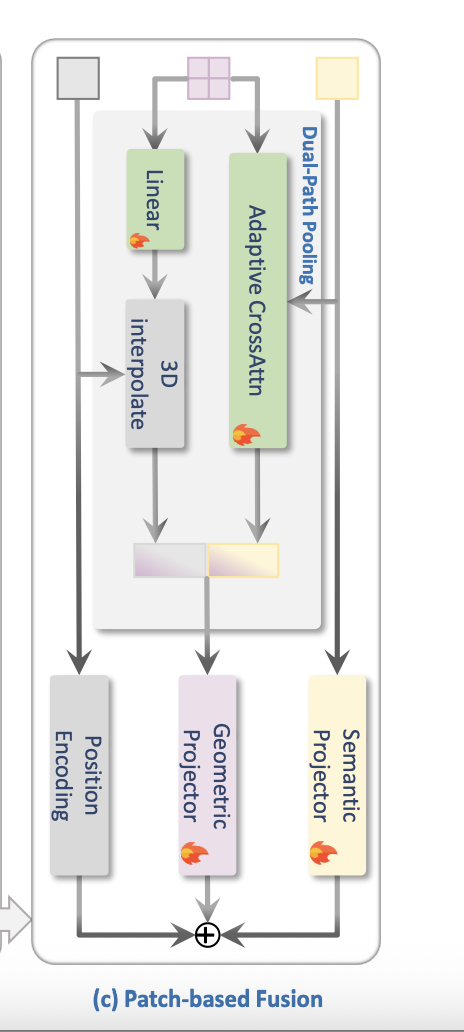

左边的 patch center 输出的是不是位置信息?这里 geometric encoder 已经通过 unpooling 获取 位置信息了,为什么还需要patch center?

并非;Geometric Encoder从 xyz rgb 提取局部信息之后,已经忘记了精确坐标;而unpooling 并非将所有点云的精确坐标还原,而是 为了与右边的 semantic encoder 的 patches对齐;把提炼出来的 3D 形状特征,重新映射、分配回对应的 2D 图像块格子里去。

对应这个

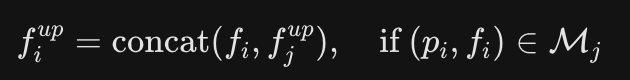

p'i 和 f'i 是一对一关系还是一对多关系?

是一对一关系,看起来fi 经过池化之后是多维的,但这多维的特征向量会映射到同一维度上进行比较,只剩下一个。

如何理解 Collecting pooled points from n' subsets yields the point set M' = ... for the next stage of encoding?

PointNet++

那么 上一层的pi,fi 和 下一层的 pi,fi是不是 多对一关系?然后这个多的倍数是|Mi|?

Yes

图片中 unpooling 这个地方没有 加上 “traniable“的图案,难道这个 unpooling 模块是个网上扒下来的现有的模型吗?它不用被训练吗?它天生就和隔壁的 Semantic Encoder对齐吗?

unpooling不是神经网络,无法被训练;

也就是说,在进行 pooling 的时候,其实丢失掉了一部分信息:无法通过高维输出恢复到 原始点云;但有一个信息没有丢失:即 高维特征对应的 点云坐标;这样子的说法对吗

Yes

前提提示:《Point Transformer V3: Simpler, Faster, Stronger》https://arxiv.org/pdf/2312.10035

空间填充曲线 (space-filling curves)

切分为子集 (partitions into subsets)

序列化注意力 (serialized attention)

Dual-Path Pooling:

position 信息 和 geometric 信息到底是怎么结合起来的?我们知道 geometric encoder 加上 unpooling 会得到不同layer的每个范围区域点云的局部和全局特征;patch center 输出的位置信息,是不是每个patch只对应一个position? 而根据这个patch的大小,我们选定 之前unpooling的某一层,其局部和全局特征就可以和position 信息对齐了 。这样的理解对吗?

2d 语义 Q 是怎么发现 自己和3D 几何 “把手”相近,而和 “墙面”特征相远的

投影

点积

训练过程

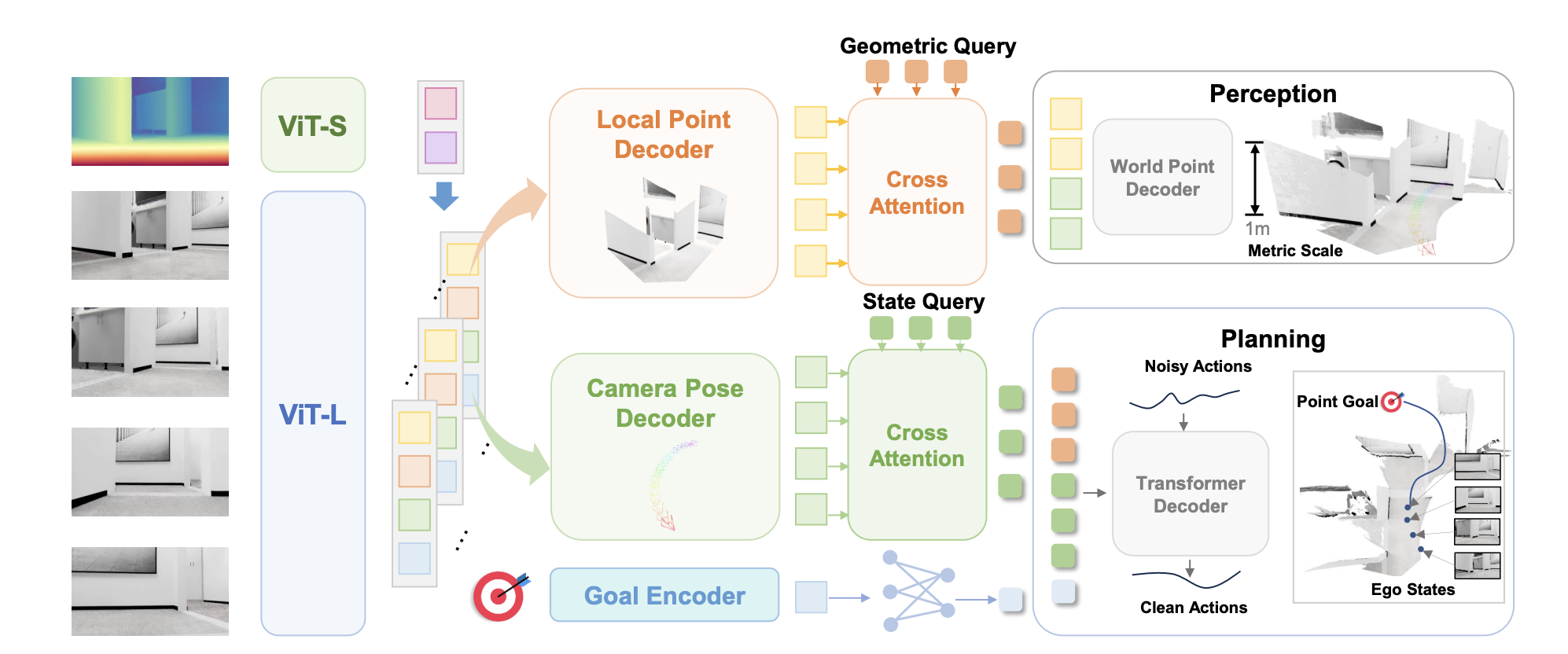

LoGoPlanner: Localization Grounded Navigation Policy with Metric-aware Visual Geometry

https://arxiv.org/pdf/2512.19629

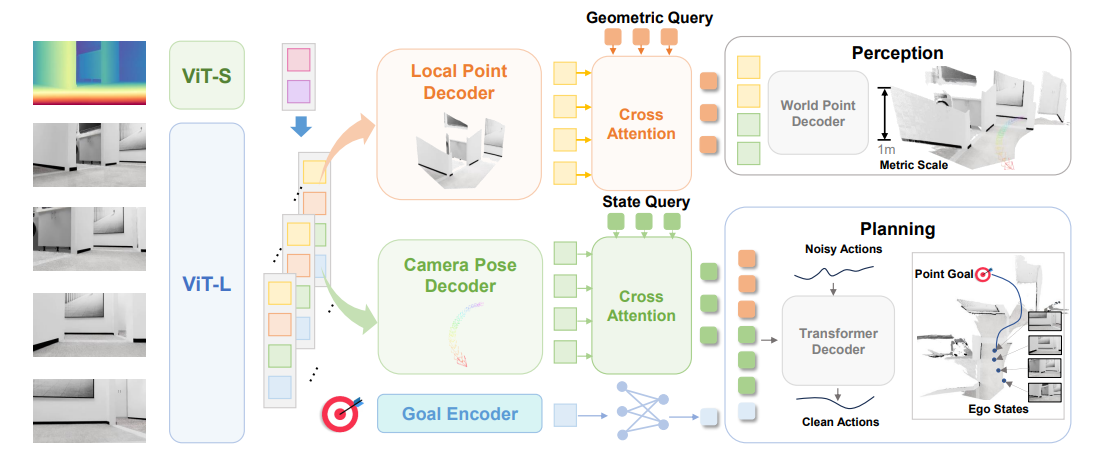

framework

端到端的优势和劣势

优势

劣势

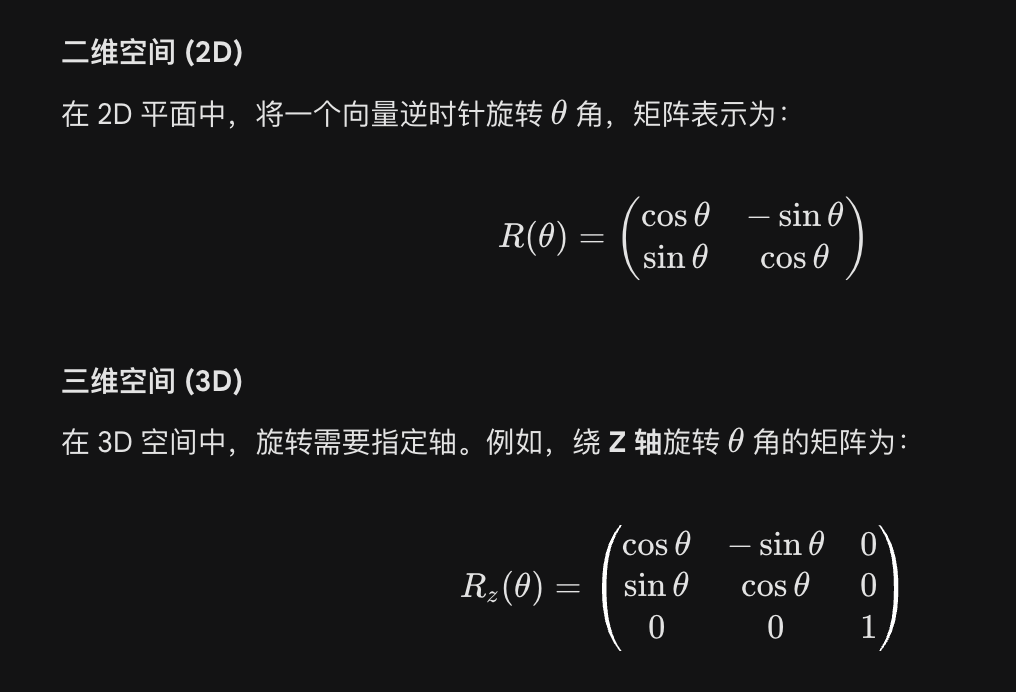

前提提示:正交旋转矩阵

简单来说,如果你想在不改变物体形状和大小的情况下,让它绕着原点转动,你所使用的数学工具就是正交旋转矩阵

数学定义

几何特性

旋转矩阵举例

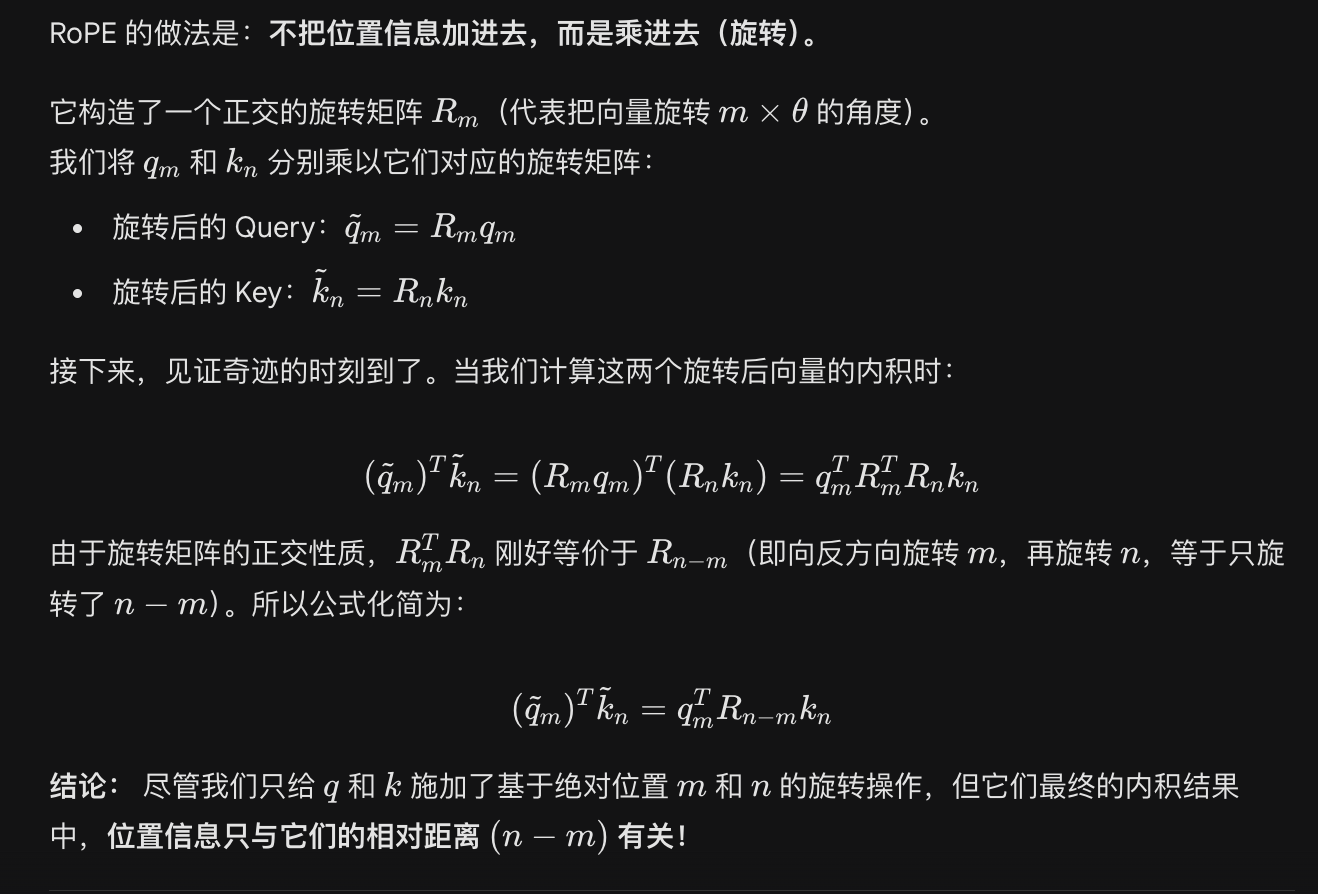

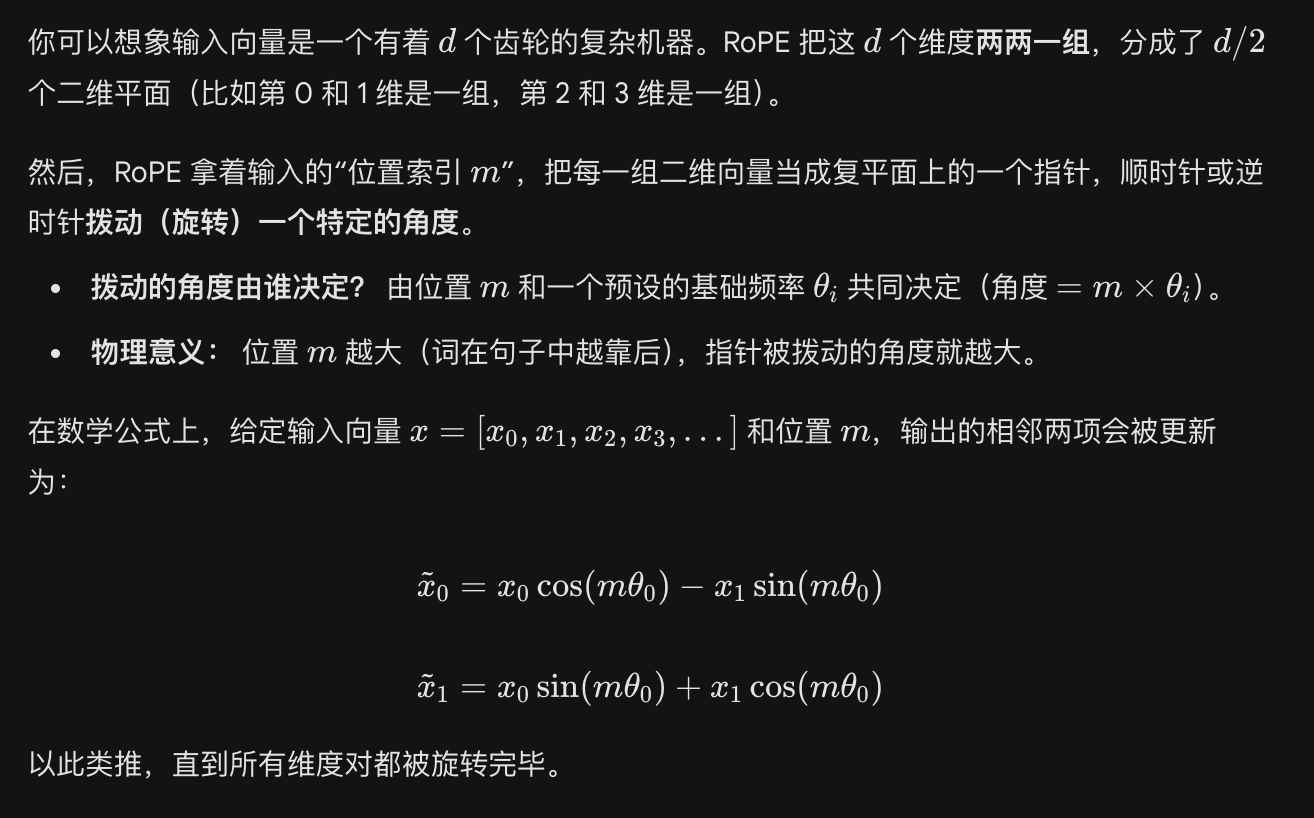

RoPE(Rotary Position Embedding,旋转位置编码)

痛点

Transformer 架构本身是个“路痴”。它的自注意力机制(Self-Attention)在计算时,是把所有词当成一个无序的集合。如果你不告诉它词的顺序,“狗咬人”和“人咬狗”对它来说没有任何区别

因此,我们需要一种方法把“位置信息”注入到模型中。RoPE 就是为了极其优雅地解决这个问题而诞生的。

传统位置编码的困境

method

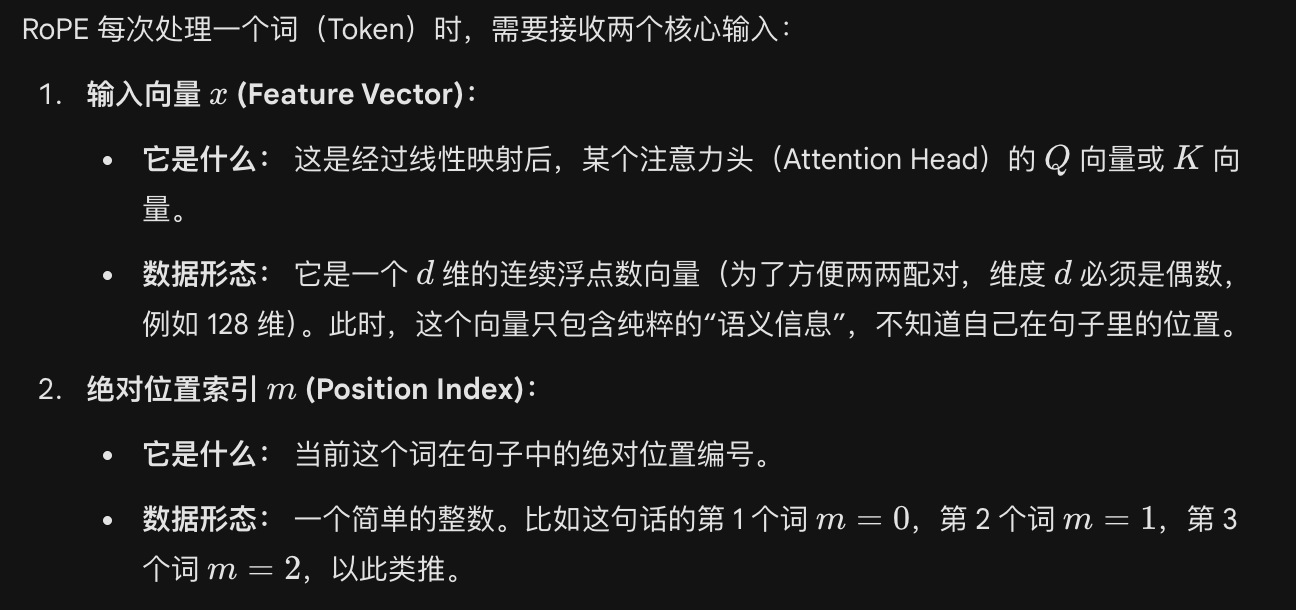

RoPE的输入输出

输入

输出

内部

为什么不直接把橙色和绿色的结果扔给规划器?

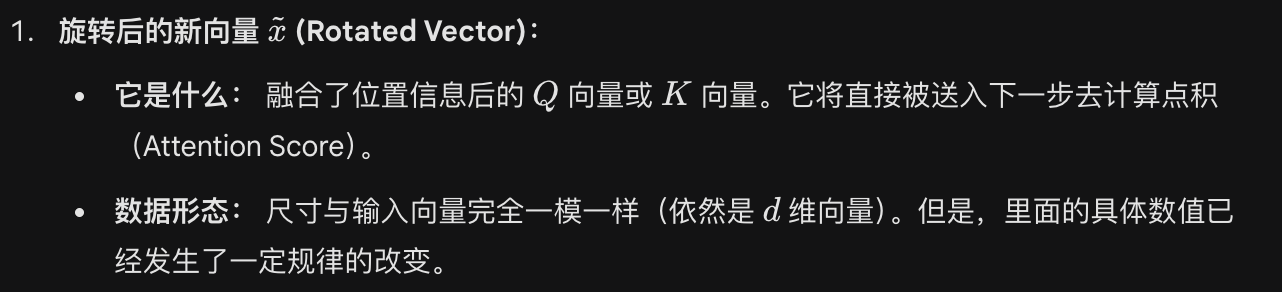

前提提示:自注意力机制在训练时的输入输出

输入输出

QKV的产生

输出(特定语境下的苹果)

反向传播

使用过程中 W 冻结,输出预测头中最大概率的

Cross-Attention(交叉注意力)

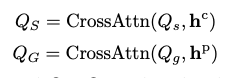

QS QG这几个 没有什么关联的向量 为什么可以在最后直接拼接?这样做有什么数学原理吗?

训练过程中的 cross attention 及其输入输出

输入

生成跨界的 K Q V

输出

反向传播

这里产生 h^c. h^p 的ϕ_c ϕ_p 也可以被最终的crossattn反向传播更新吗?由最终的结果,一路更新到之前的 ϕ_c ϕ_p , 这就是端到端训练吗?为什么不进行分模块训练?是因为中间的模块 没有明确的监督数据吗?

是端到端

不是因为没有监督数据,在真实世界的机器人训练中,我们有大量的“中间监督数据”(比如极其精准的 3D 激光雷达点云图、高精度的相机定位坐标 Ground Truth)。传统的“分模块训练”正是利用这些数据,先把感知模块训练到 100 分,再把定位模块训练到 100 分。

既然各个模块都能考 100 分,为什么还要搞端到端?因为分模块训练存在两大无法逾越的死穴

LoGoPlanner的训练方法并非完全端到端

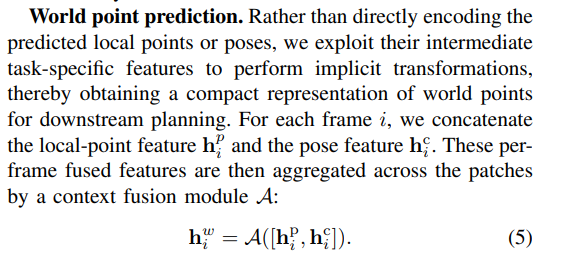

为什么 这里要用 intermediate 数据来预测 reconstucted world,而不是前面 intermediate 数据转化得到的 显式 点云 和 pose

一方面是为了 紧凑

为什么 CrossAttn 的结果 是 Q_S 而不叫 V_S?

1. 在CrossAttn中,Q的长度往往和V的长度不一样,但输出中长度和 Q一样

2. CrossAttn有残差相加,提取出来的结果加到了原始Q身上

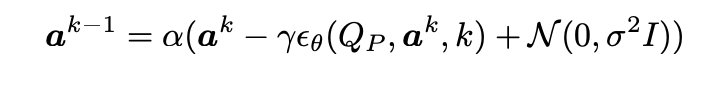

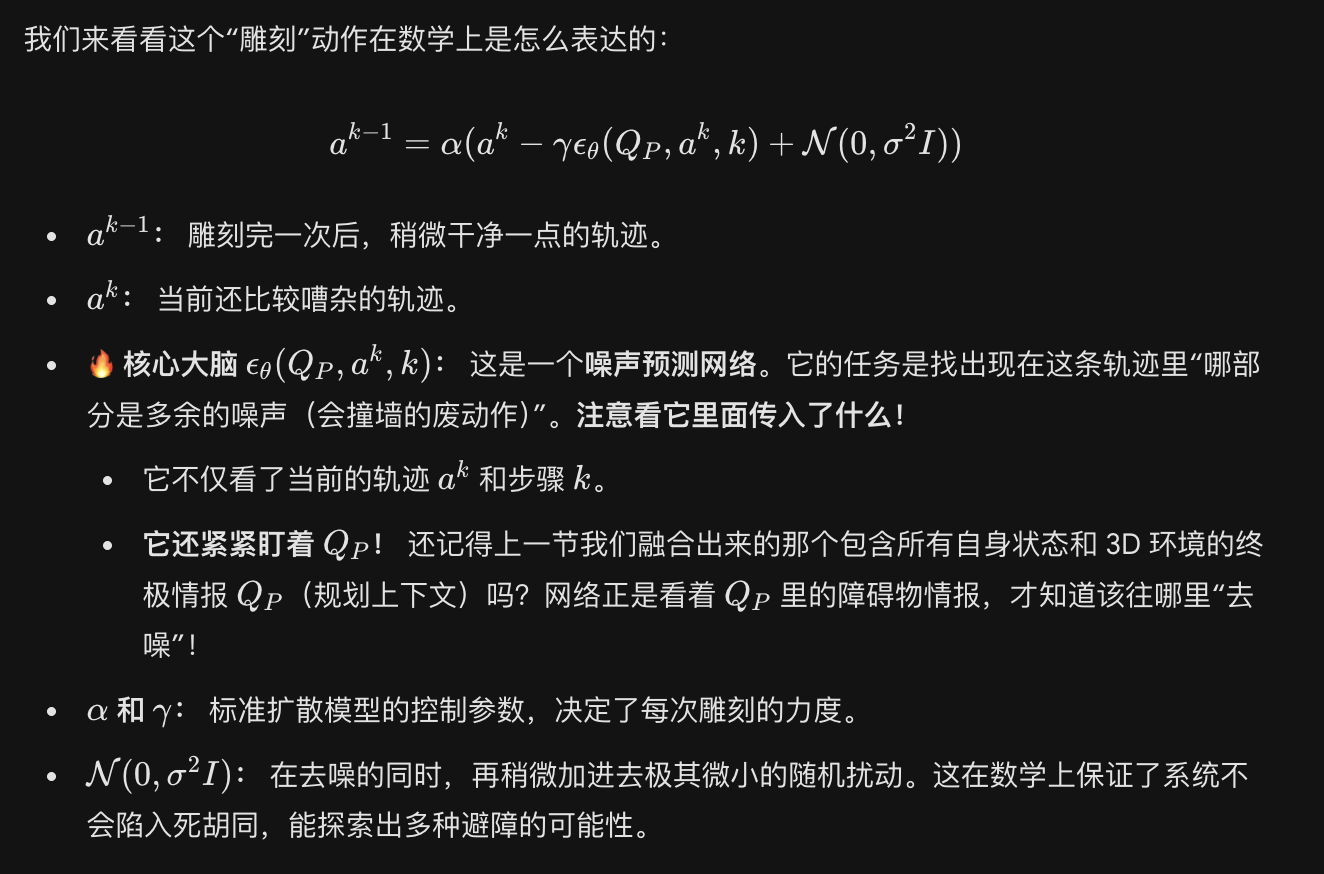

如何解释此公式

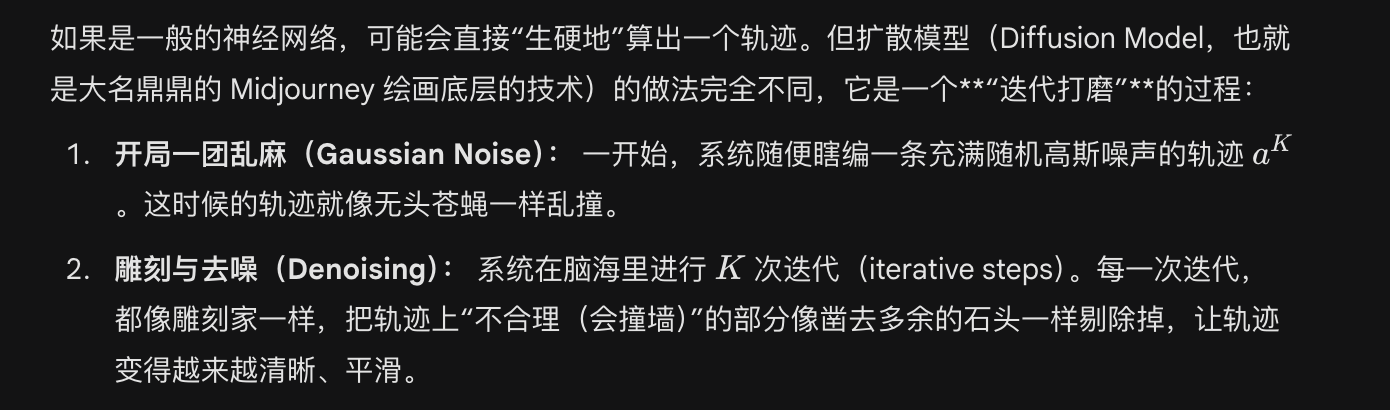

扩散模型

公式拆解

如何理解 “交替注意力机制在帧内注意力和帧间注意力之间交替,同时提高了局部保真度和长时段一致性”?

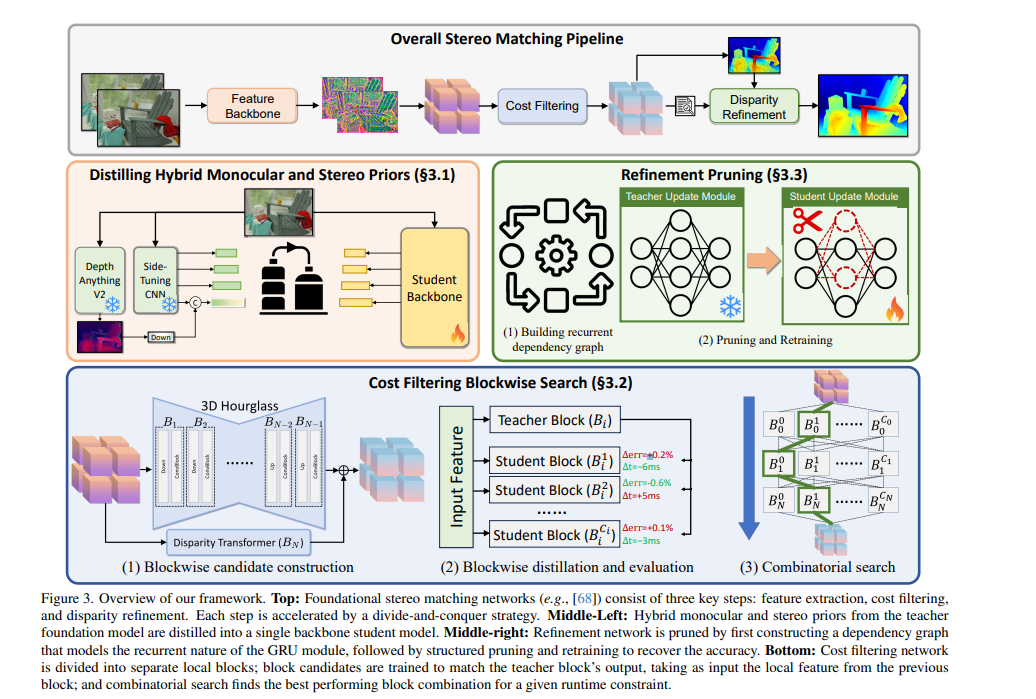

Fast-FoundationStereo: Real-Time Zero-Shot Stereo Matching

https://arxiv.org/pdf/2512.11130

framework

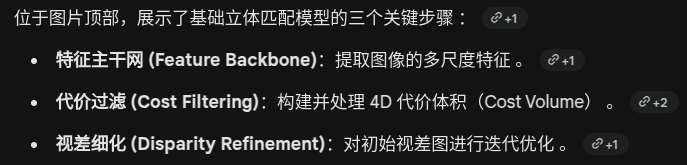

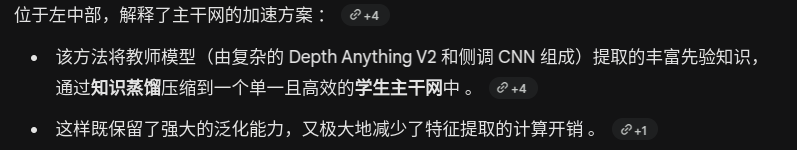

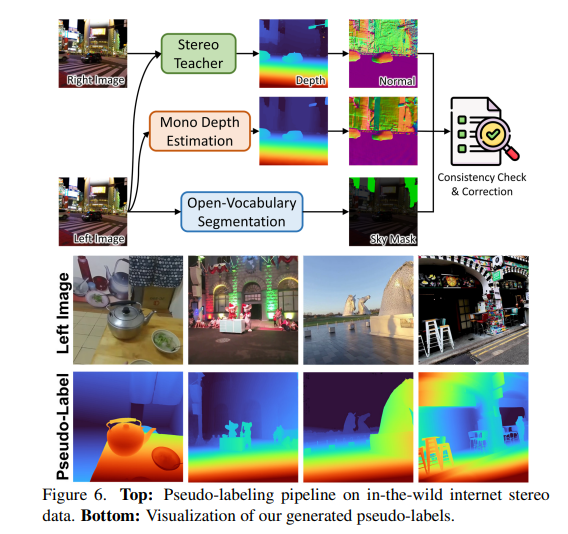

总体立体匹配流水线

混合单目与立体先验蒸馏

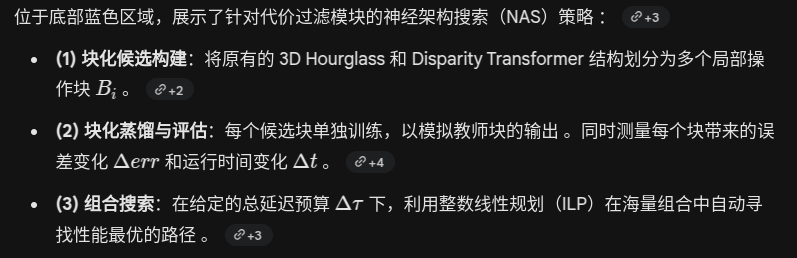

代价过滤的块化搜索

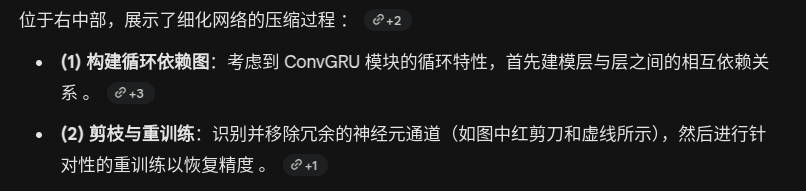

细化模块剪枝

伪标签的产生

伪标签用于蒸馏过程的监督

对大模型的剪枝是如何进行的?

策略1,非结构化剪枝

结构化剪枝

Post Training Pruning

前提提示: Side-Tuning(旁路微调)https://arxiv.org/pdf/1912.13503

痛点

Side-Tuning 工作原理

优势

既然 S(x) 是为了 预测残差的,那么最终特征应该是 B(x) + S(x) 啊, 为什么是加权之后的呢

初始化时,我们不需要额外设计一个S(x)

让模型学会自适应

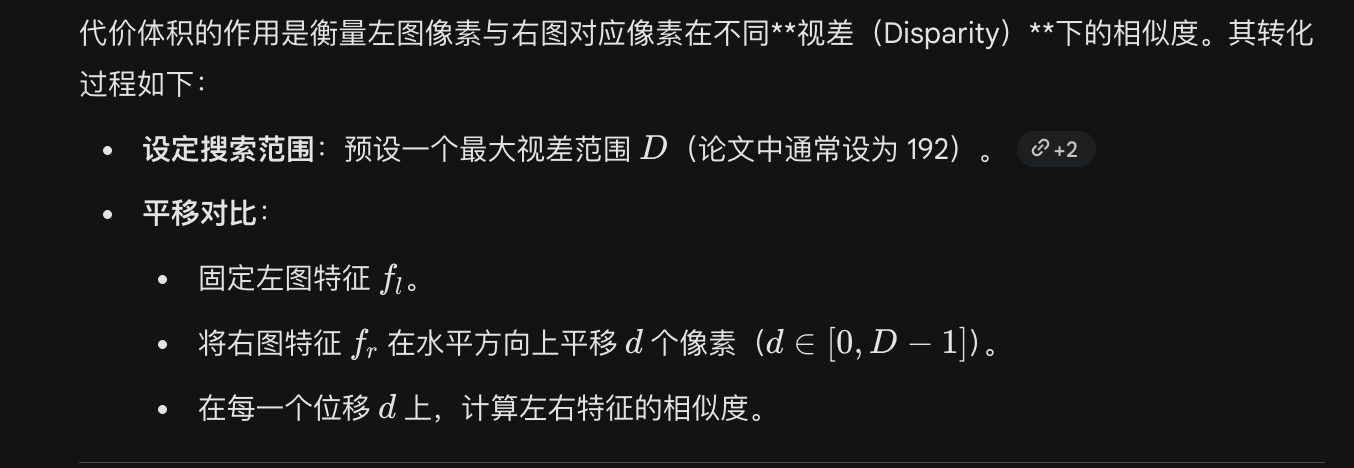

在第一刀(特征提取)拿到左右眼的特征后,系统要把它们放在一起“比对”,生成一个极其庞大的数学矩阵——代价体积(Cost volumn)

记录的是左眼和右眼在不同视差下的“匹配得分”

“DepthAnything V2 和 侧调CNN “的输出

也就是说,左眼图片 在经过整个 “DepthAnything V2 和 侧调CNN “(或者是后面的学生模型),进行特征提取的时候,是不包含右眼图片的信息的; 那最后 f(i) 属于 Ci H/i W/i 是怎么转化为 Vc 的?

是的, 无论是教师模型还是学生模型,它们执行的都是一元特征提取(Unary Feature Extraction)。这意味着在提取左图特征 fl 时,网络完全不知道右图的存在,反之亦然

将这些独立的特征转化为 代价体积(Cost Volume, VC) 的过程,本质上是一个“滑动窗口匹配”的过程。

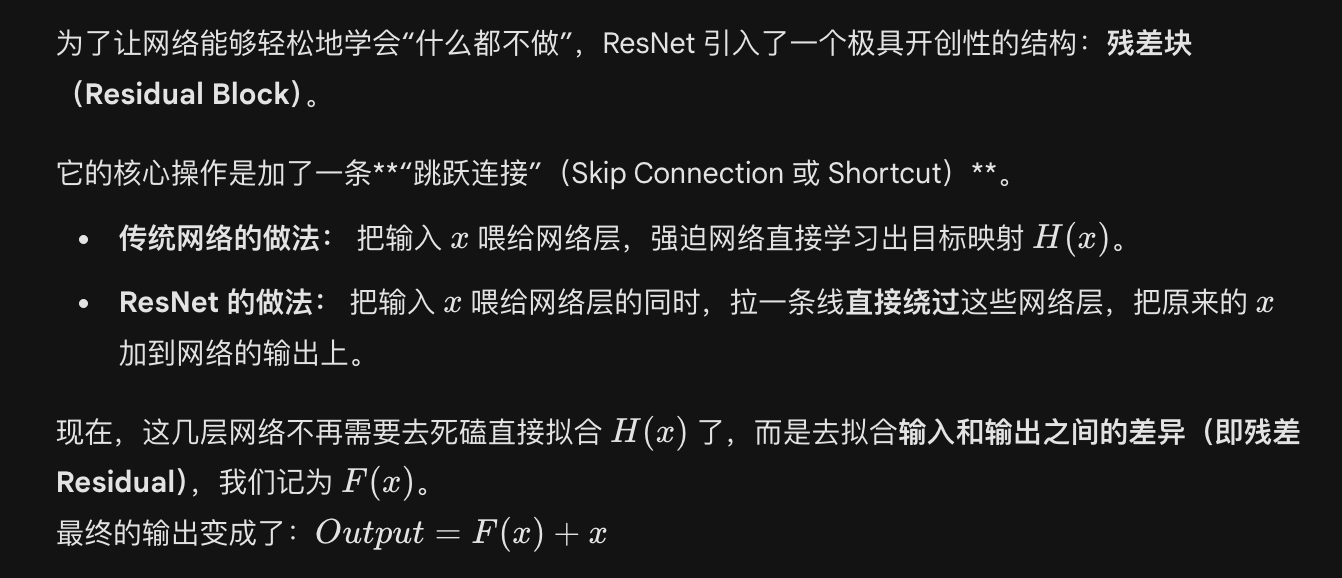

ResNet

痛点

残差连接

优势

权重矩阵

适应非线性激活函数

文中提到的5个layers

(1) 3D conv layer with varying channel dimensions

类比2D conv layer,这里是 varying channel是因为:如果系统发现算力预算吃紧了,它可以自动挑一个“把通道数压缩一半”的 3D 卷积层,牺牲一丢丢精度来换取极大的速度提升。

(2) 3D deconv layer that doubles the spatial dimensions of the cost volume

为什么要放大?

如何将维度翻倍?

(3) APC layer that performs separate spatial and disparity convolution with different respective kernel sizes

痛点

APC卷积方法

可变的卷积核大小

(4) residually connected 3D conv layers, similar to ResNet

ConvGRU 输入输出

多尺度金字塔特征是 怎么 变成 初始视差图的?

构建代价体积

代价滤波与聚合 (Cost Filtering & Aggregation)

初始视差预测 (Initial Disparity Prediction)

ffs输出的 视差图作用?

V-Thinker: Interactive Thinking with Images

https://arxiv.org/pdf/2511.04460

V-Thinker 的整个训练框架

第一阶段:感知对齐 (Perception Alignment)

第二阶段:交互推理对齐 (Interactive Reasoning Alignment)

Cold-Start SFT 和 Reinforcement Learning对比

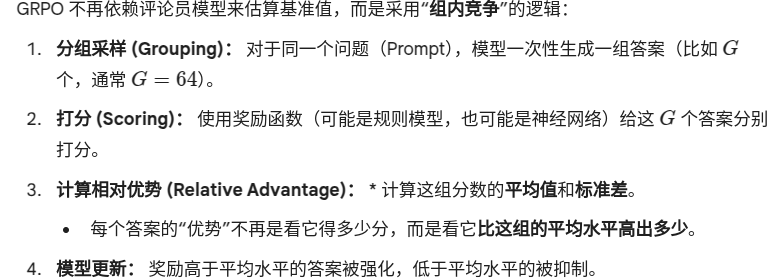

GRPO相对于PPO的优势

对比PPO

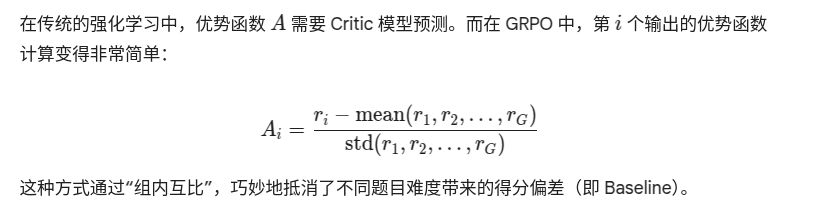

GRPO的工作原理

GRPO数学直觉

PPO 的四个模型的分别作用

在公式 (DK, Tˆ) = G(Combos(K)). 之中,是不是可以理解为 G 生产的 Dk 包含代码,然后先通过运行代码获得图片,然后根据图片中的信息进行 工具的挑选,生成;还是通过 code 直接生成 T

直接生成,而不是“先运行再挑选”的闭环

生成器 G 的工作逻辑

只有在这个时候才会运行代码并观察:

如何在这样一次次迭代中,防止最终得出的T或K和一开始输入的T和K大相径庭,从而产生问题?

扩张函数 phi :利用 BGE(一种文本嵌入模型)进行层次聚类,对新生成的元素进行过滤、合并和归一化 ; 如果生成的“新工具”只是对现有工具的重复描述或微小改动,聚类机制会将其合并;如果生成的“新知识”逻辑混乱,过滤器会将其剔除 。

协同校准中,生成的 Python 代码会在沙盒中真实运行 。如果模型构思出的“新工具”在几何逻辑上画不出来,或者渲染出的图像与问题答案对不上,检查器会直接判定该样本无效 。

论文认为这种从零开始的生成(From Scratch)并非漂移,而是一种正向的演化;通过限定工具来构思知识(或反之),模型能发现许多人类在标注数据时难以覆盖的正交 (Orthogonal) 知识组合 。例如,模型可能会发现一种结合了“偏微分方程”和“动态阻尼标注”的新型交互题型,这是单纯靠数据蒸馏(Distillation)无法得到的 。

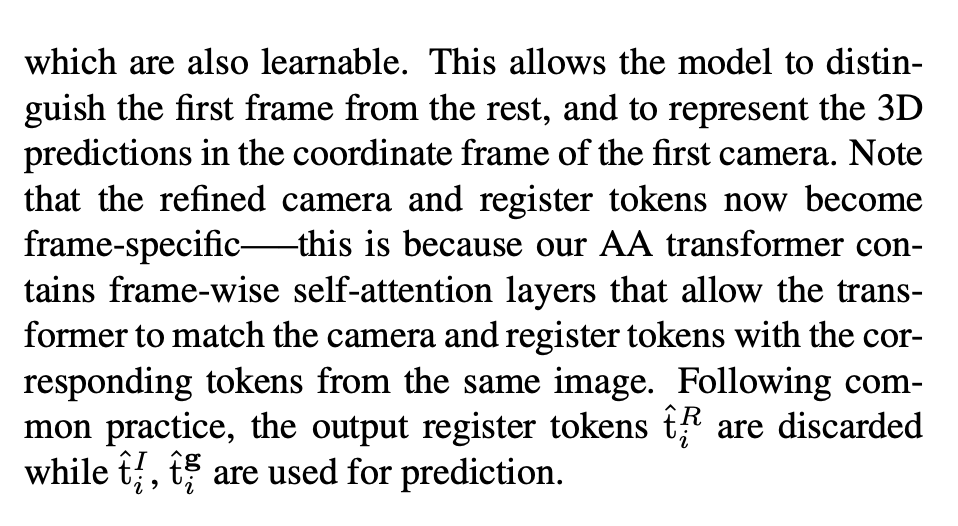

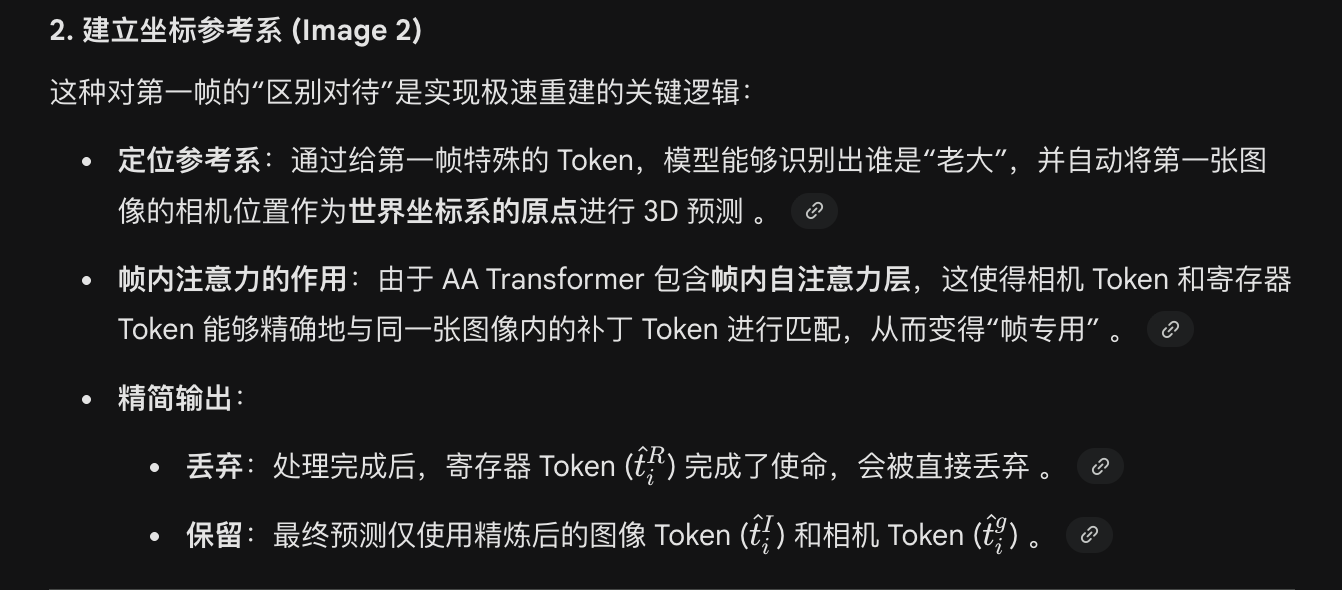

VGGT

https://arxiv.org/pdf/2503.11651

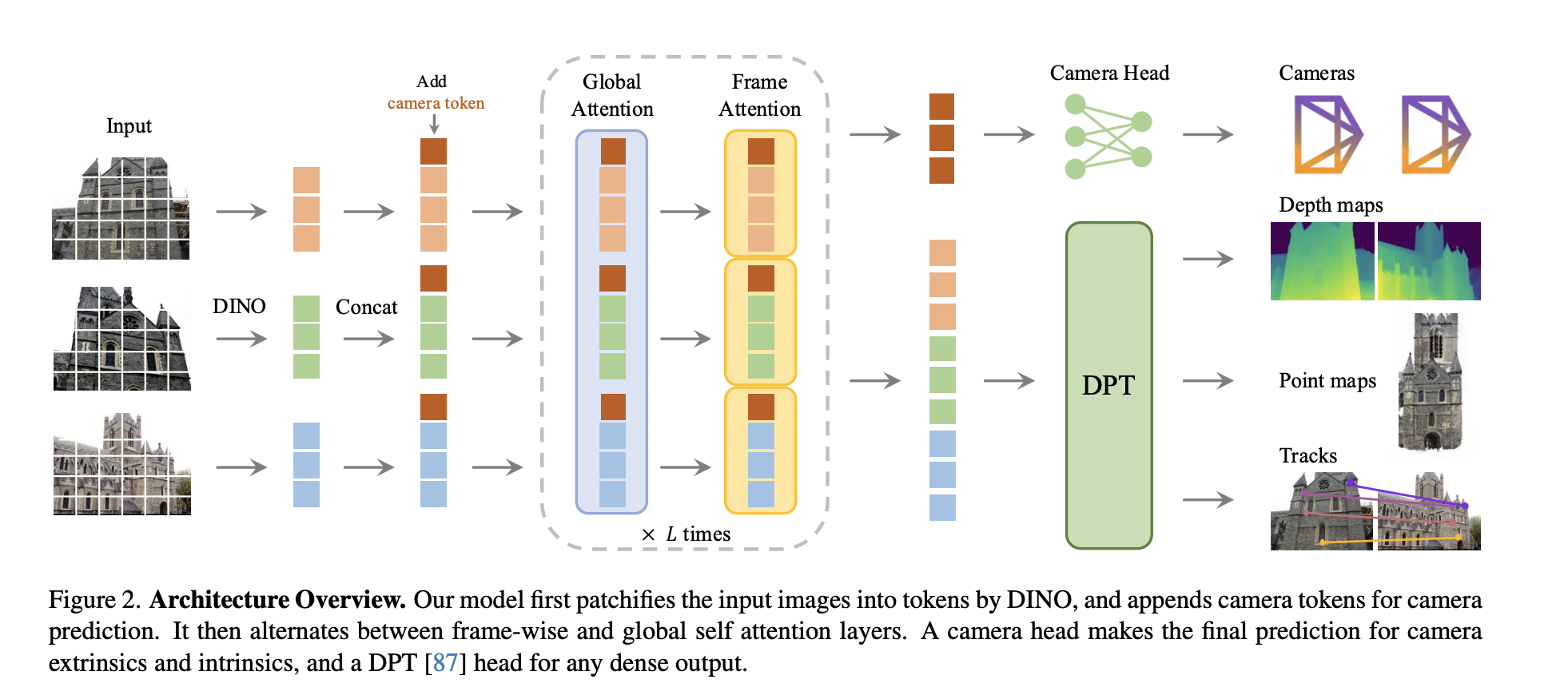

framework

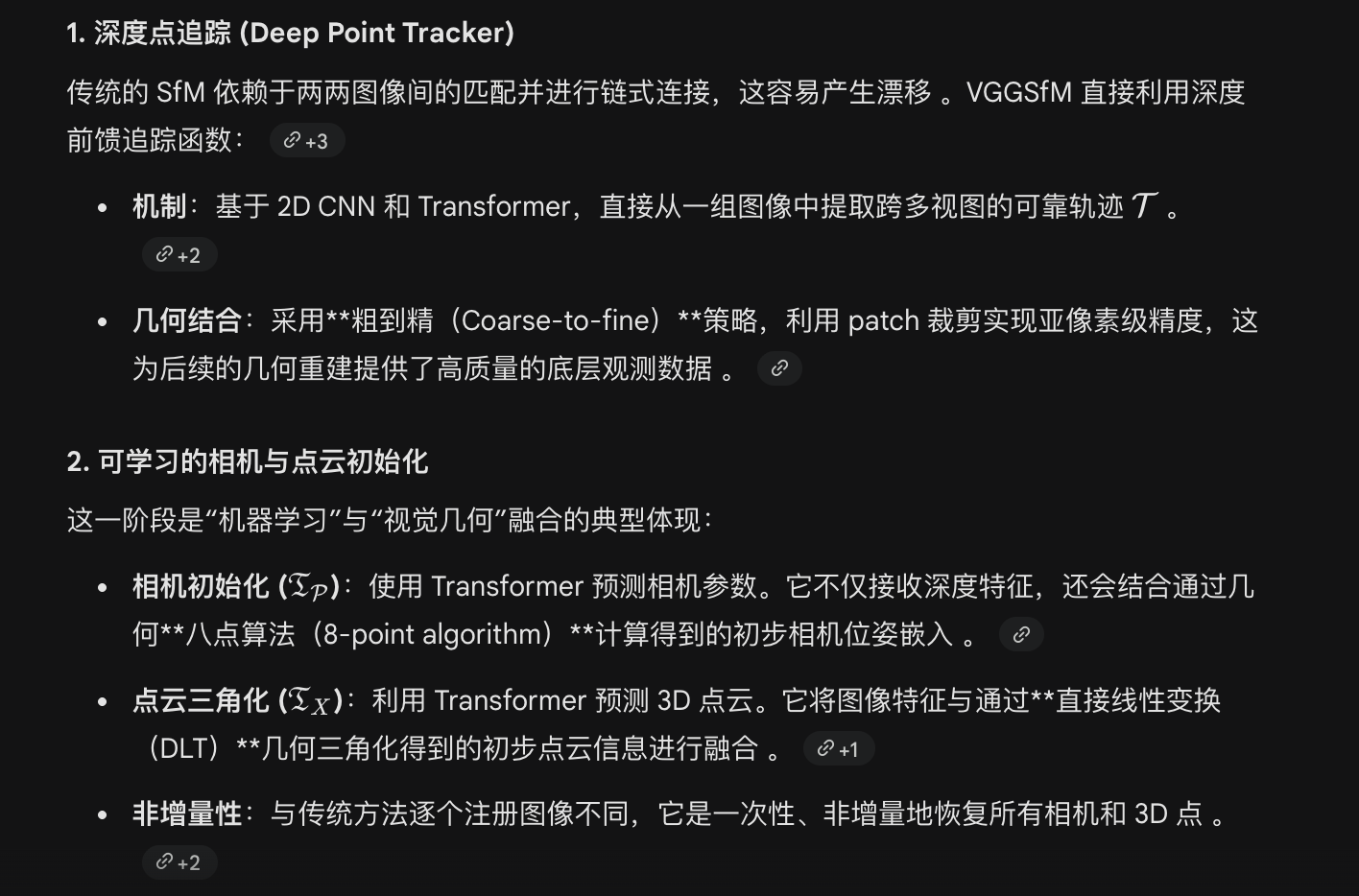

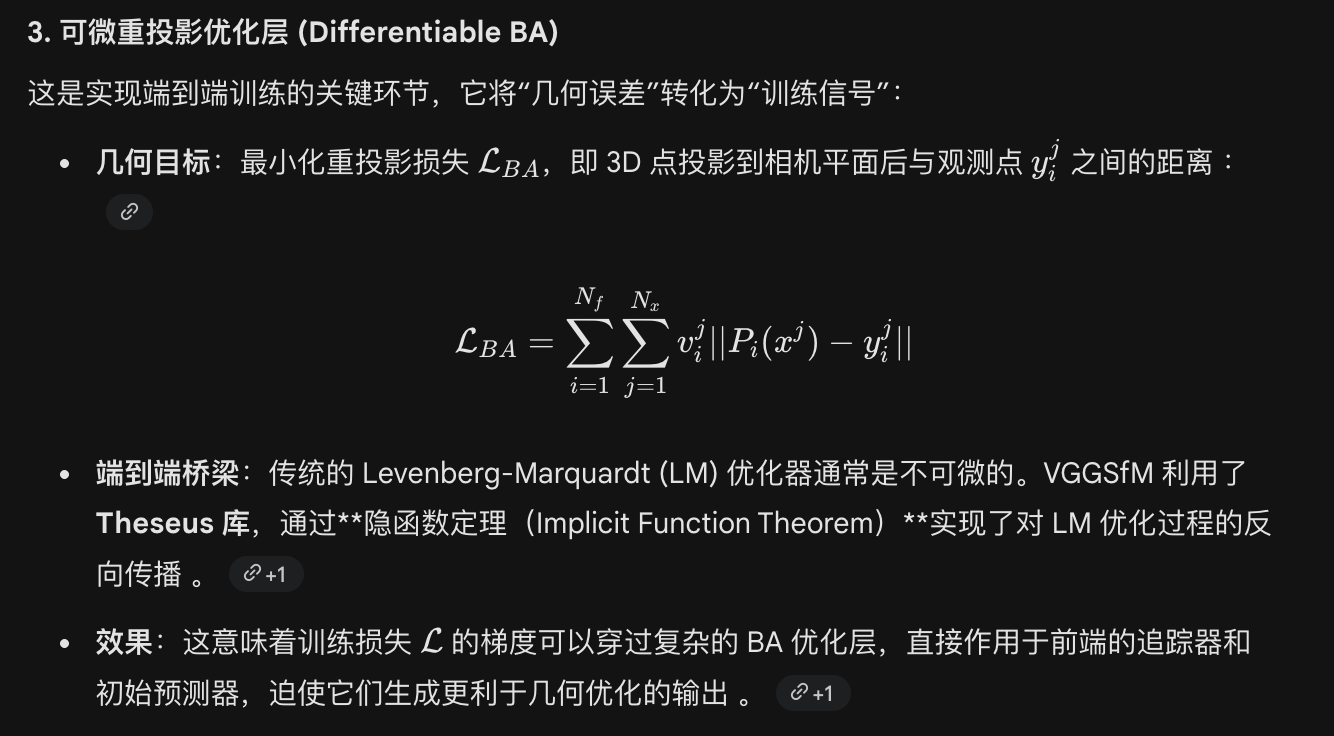

What is the way VGGSfM [125] combines machine learning and visual geometry end-to-end via differentiable BA?

为什么 传统的 重建 不将 不同视角的点云 放在同一个空间体系下?

1. 传统重建是一个典型的“迭代优化”过程

2. 计算复杂性与累积误差

点云表示P

维度为 3*H*W, image上每个点对应的 xyz坐标值,而不是深度

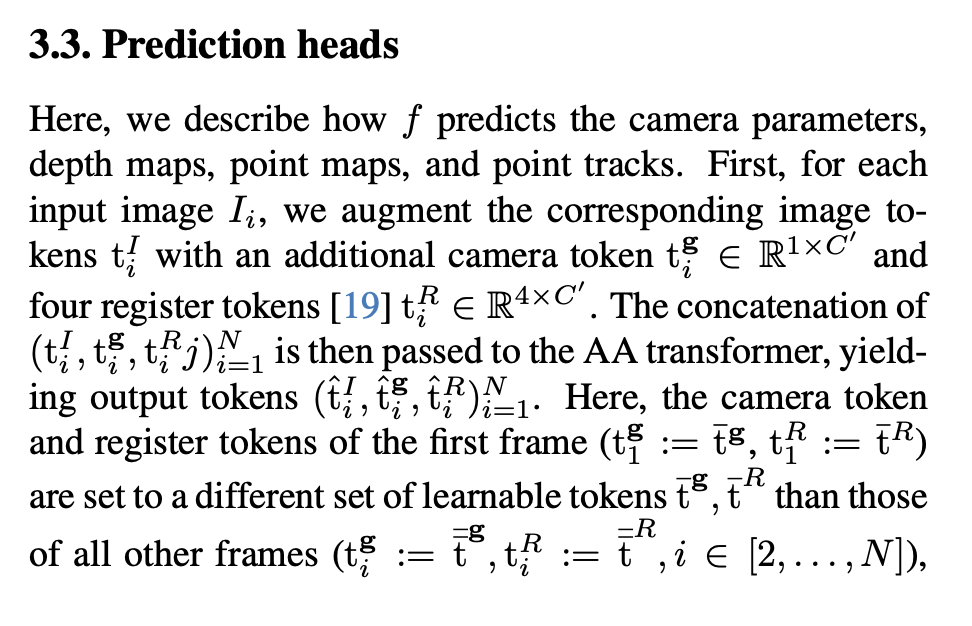

Prediction Head

camera_token 和 register_token 实现细节(源码)

# Note: We have two camera tokens, one for the first frame and one for the rest

# The same applies for register tokens

self.camera_token = nn.Parameter(torch.randn(1, 2, 1, embed_dim))

self.register_token = nn.Parameter(torch.randn(1, 2, num_register_tokens, embed_dim))

# The patch tokens start after the camera and register tokens

self.patch_start_idx = 1 + num_register_tokensself.camera_token: 形状(1, 2, 1, embed_dim)—— 两套路由:第 0 槽给首帧,第 1 槽给其余帧。self.register_token: 形状(1, 2, 4, embed_dim)—— 同样 首帧 / 非首帧 各一套 4 个 register。patch_start_idx = 1 + num_register_tokens(默认 5),表示 patch 从第 5 个位置开始(前 1 个相机 + 4 个 register)。patch 指的是:把整张图切成网格后,每个小格(patch)对应的一个视觉特征向量

对 RoPE,

patch_start_idx之前的 token 位置被置为 0(与「相机/register 不参与 patch 网格位置编码」一致)

前向过程中

每个

forward里用当前的self.camera_token/self.register_token展开,与patch_tokens拼成完整序列

# Expand camera and register tokens to match batch size and sequence length

camera_token = slice_expand_and_flatten(self.camera_token, B, S)

register_token = slice_expand_and_flatten(self.register_token, B, S)

# Concatenate special tokens with patch tokens

tokens = torch.cat([camera_token, register_token, patch_tokens], dim=1)拼好的

tokens依次经过 frame / global 的Block,和 patch 一起做 self-attention、FFN。此时 第 0 位是相机 token 的隐藏状态,第 1–4 位是 register 的隐藏状态,它们每层都会被更新。

下游如何使用?

相机:

CameraHead取最后一层输出的[:, :, 0](相机槽),和register_token参数无直接索引关系,但相机槽在 Transformer 里一直和 register、patch 交互。深度 / 点云 / DPT 特征:从

patch_start_idx(默认 5) 往后只取 patch,不读 register 槽;但 patch 表示仍受前面与 register 的 attention 影响。

AA Transformer:frame(帧内)与 global(跨帧)交替

初始化:

aa_order=["frame", "global"],depth个 block 分成frame_blocks与global_blocks两套参数。帧内自注意力:

_process_frame_attention保持 (B*S, P, C),即每个 frame 的 P 个 token 内部做 attention(对应图里的 intra-frame)。全局自注意力:

_process_global_attentionreshape 成 (B, S*P, C),所有帧所有 token 一起 attention。

for _ in range(self.aa_block_num):

for attn_type in self.aa_order:

if attn_type == "frame":

tokens, frame_idx, frame_intermediates = self._process_frame_attention(

tokens, B, S, P, C, frame_idx, pos=pos

)

elif attn_type == "global":

tokens, global_idx, global_intermediates = self._process_global_attention(

tokens, B, S, P, C, global_idx, pos=pos

)

...

concat_inter = torch.cat([frame_intermediates[i], global_intermediates[i]], dim=-1)

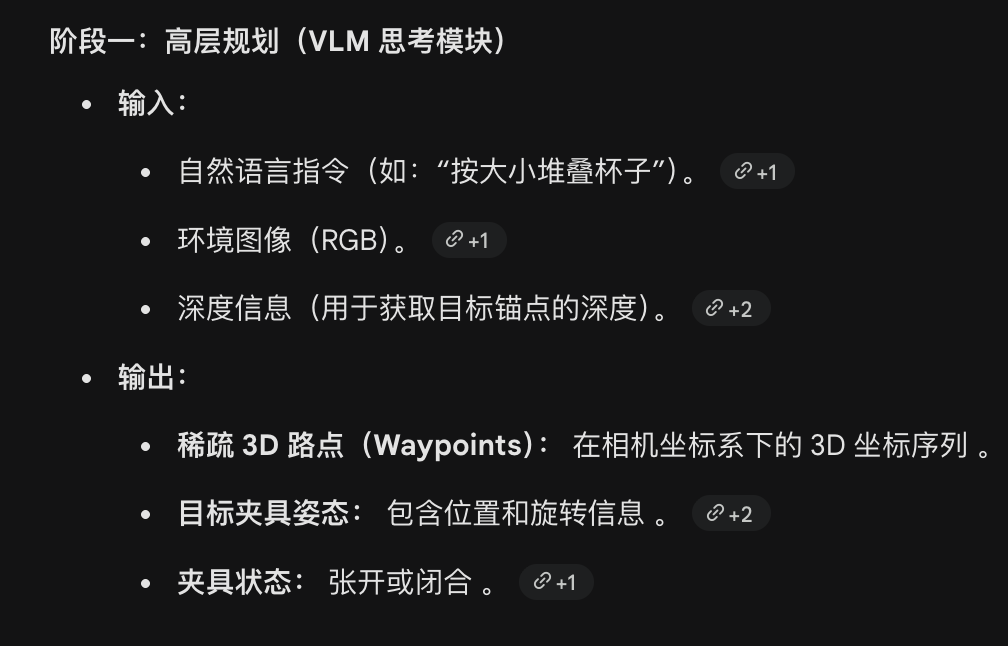

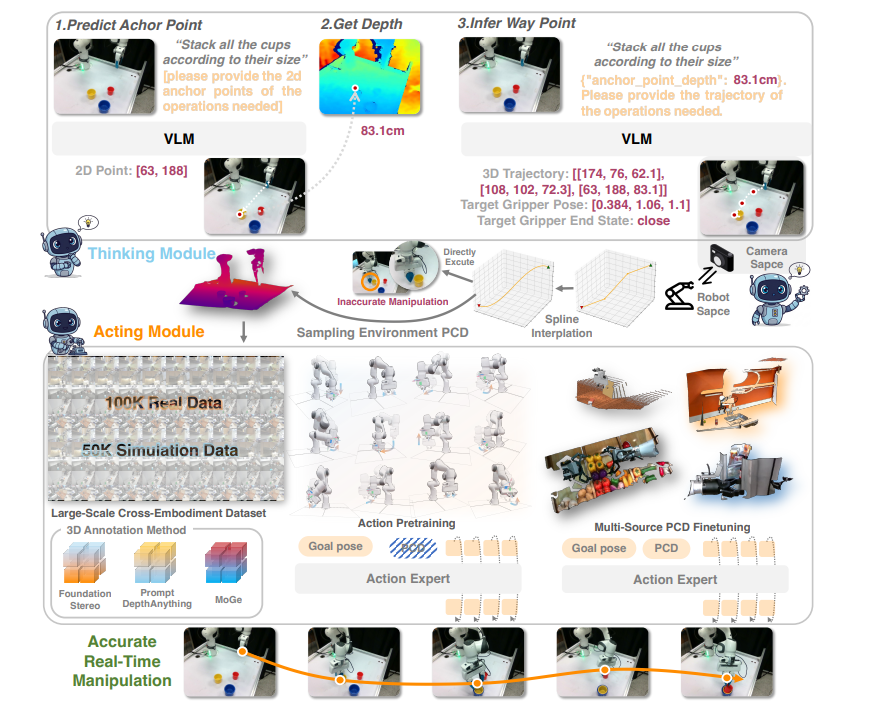

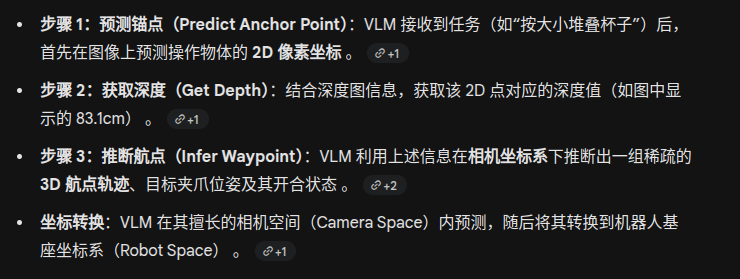

output_list.append(concat_inter)BRIDGE THINKING AND ACTING: UNLEASHING PHYSICAL POTENTIAL OF VLM WITH GENERALIZABLE ACTION EXPERT

https://arxiv.org/abs/2510.03896

framework

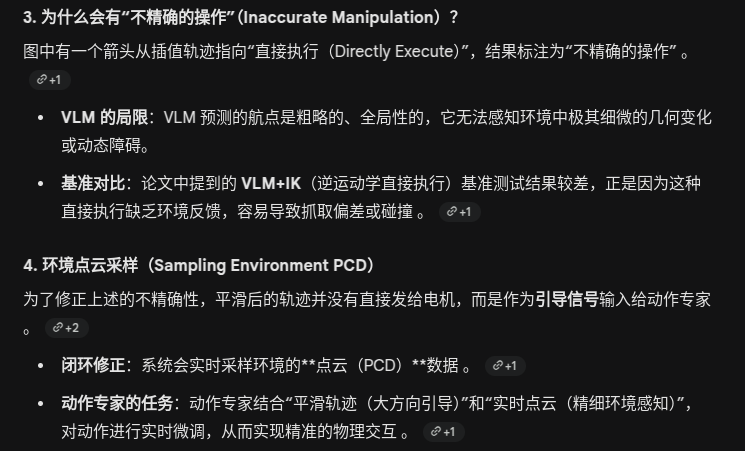

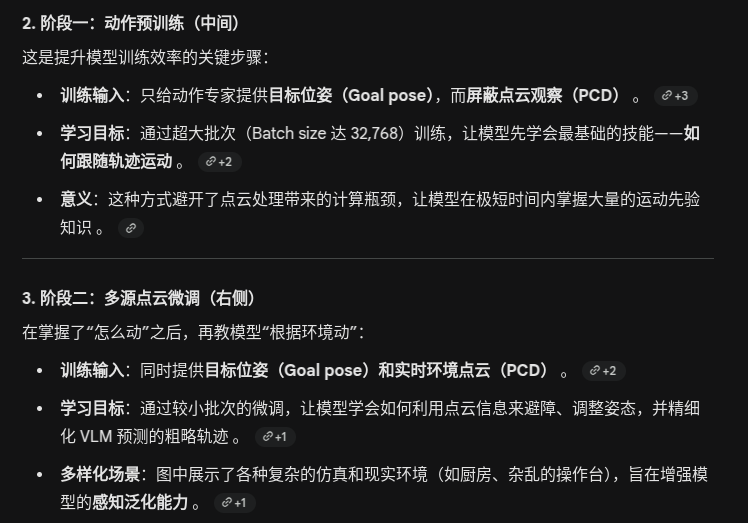

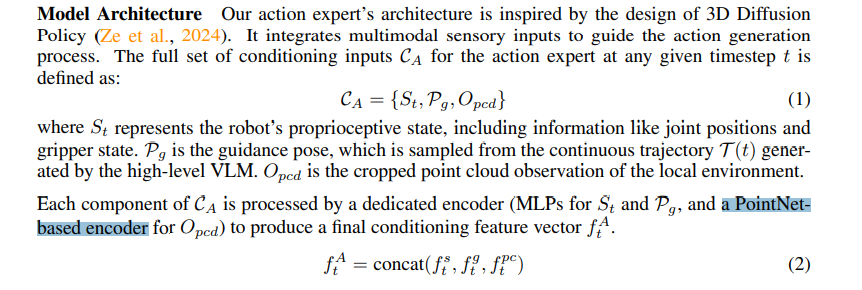

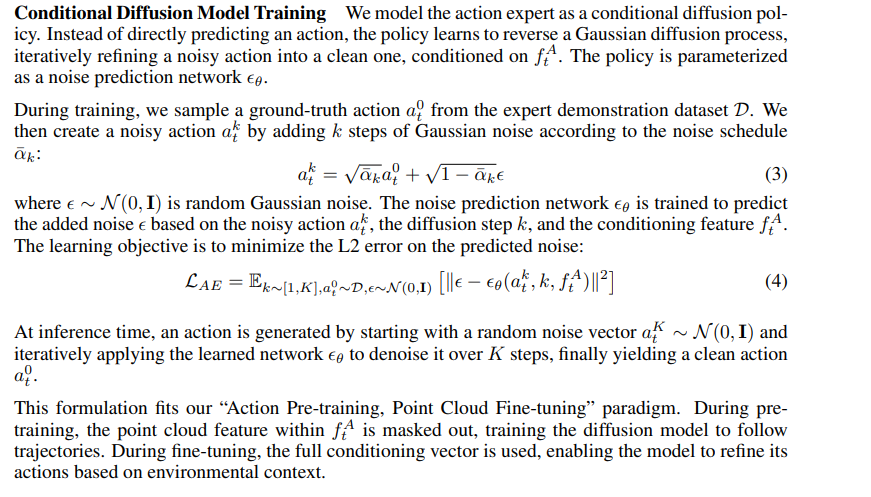

思考模块:VLM 路径规划

中间步骤

动作训练

重点:为何要先屏蔽PCD,旨在 避免计算瓶颈

将推理与动作集成到单体架构中的局限是什么?

结构:端到端

问题

灾难性遗忘

推理与执行的混淆 单体模型将高层语义推理与底层几何动作混在一起 。因为动作模块必须同时处理复杂的语义信息,这使得它很难在不同任务之间进行大规模的交叉训练,导致模型在面对新环境或新任务时泛化能力极差

为什么混在一起会导致很难交叉训练和泛化?

1. 动作模块必须处理复杂的语义信息

由于没有明确的中间接口,负责驱动电机或关节的执行部分无法只专注于“几何位移”,它必须先从这些复杂的语义信号中“解读”出任务意图,才能决定下一步怎么走 。

这让动作模块陷入了两难:它既需要足够轻量级以保证实时执行,又被要求具备解析高层语义的能力

2. 为什么这会导致大规模训练困难且泛化极差

因为动作模块要学习的是“语义到动作”的映射,而非纯粹的“几何到动作”映射,这使得不同来源、不同任务的数据很难在同一个模型下进行有效的大规模交叉训练 。

为了让机器人学会特定的物理控制,通常需要在规模较小、领域狭窄(Narrow-domain)的机器人数据上进行微调;从而导致VLM灾难性遗忘

伪解耦:之前的解耦只是形式上的拆分,并没有实现功能上的减负。动作模块依然要分出大量的计算资源去“理解任务”,而不是专心“搞物理动作”

为什么 传统的视觉-语言-动作(VLA)模型通常直接预测机器人基座坐标系(Robot's base frame)下的坐标 ?而不是 先 预测相机坐标,再进行转换?

因为是端到端...

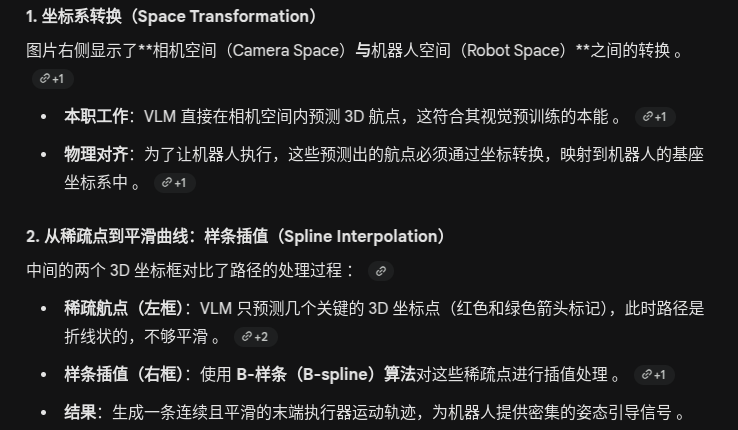

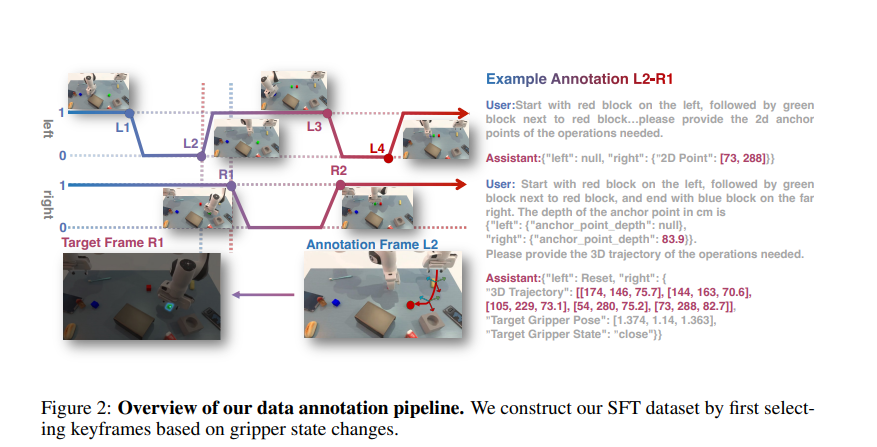

有监督微调(SFT)数据集的标注流程

关键帧选择

标注对话示例

这种训练方式让 VLM 学会了如何根据 2D 图像和深度先验,在脑海中构建出物理世界的 3D 运动路径 。

由于采用的是对话式的 SFT(有监督微调),VLM 在学会给机器人指路的同时,能最大程度地保留其原有的语言和推理能力

这里好像就给给了 一个关键点的深度信息,这足够吗?为了获得轨迹是不是应该给出更多的深度信息?

VLM 本身是在海量互联网数据上预训练的,拥有强大的视觉空间推理能力 。

论文的核心理念是不要让 VLM 去干“体力活”; 保持接口简洁

什么是 point cloud downsampling

从原始的 3D 点云数据中提取出一个规模更小、更具代表性的点集的过程

为什么需要下采样

论文中的下采样方法

其他

动作模型

全连接层的作用

使得 S,P 经过全连接层可以对齐,方便拼接

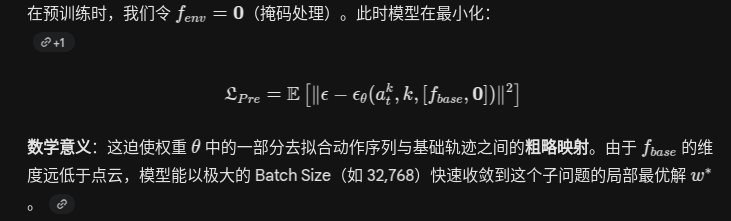

我一直很好奇,为什么 现有掩码 再 不加以掩码这样的方式不会破坏预训练的结果,请从数学上证明为什么是可行的?

目标函数分解

预训练

学习残差修正

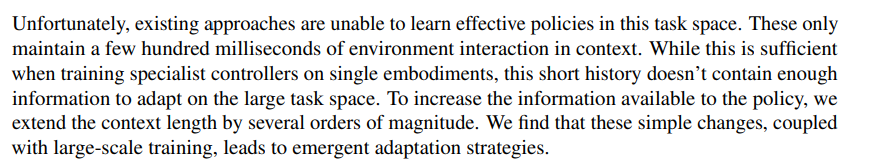

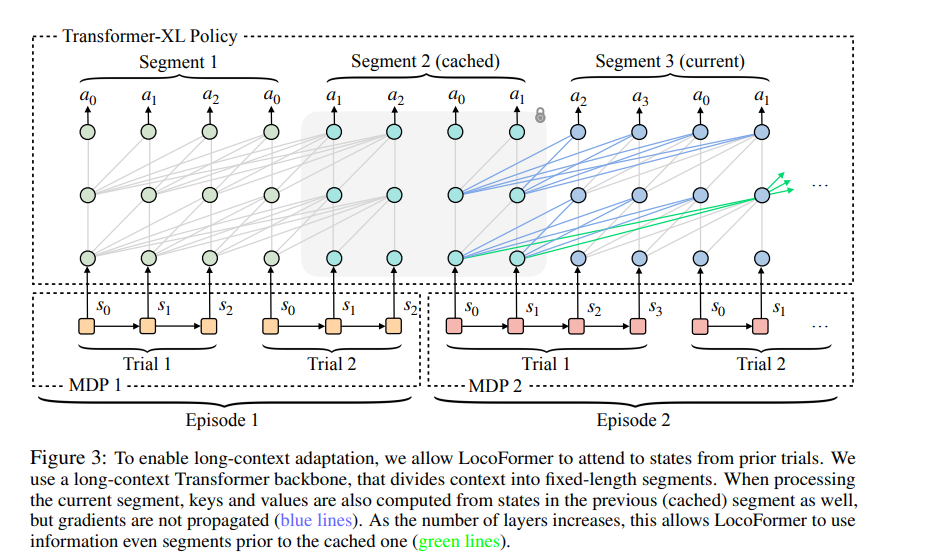

LocoFormer: Generalist Locomotion via Long-context Adaptation

https://arxiv.org/pdf/2509.23745

什么是 a few hundred milliseconds of environment interaction in context.?为什么这样就已经sufficient when training specialist controllers on single embodiments

什么是上下文中的数百毫秒环境交互?

在控制机器人运动时,AI 模型不仅看当前的传感器数据,还会参考一段过去的交互历史,这被称为“上下文” (Context) 。

时间尺度: 这里的“数百毫秒”意味着 AI 只保留极短的记忆(通常在 100ms 到 500ms 之间)。

内容: 这些信息包括机器人过去几步的关节位置、传感器读数和采取过的动作 。模型利用这段极短的历史来预测下一步该如何保持平衡。

为什么这对“单一体态的专家控制器”是足够的?

专家控制器 (Specialist controllers) 是专门为某一种特定机器人(单一体态,Single embodiment)量身定制的 。在以下情况下,短记忆是足够的:

物理特性已知且固定: 因为机器人是特定的,它的腿长、重量分布和电机性能在训练时就已经确定了,模型不需要通过长期的记忆来“摸索”自己身体的构造 。

仅需应对瞬时干扰: 对于特定机器人来说,控制的关键在于应对突发的小扰动(如踩到小石子或被轻推一下)。这些物理反应通常发生在毫秒量级,因此几百毫秒的历史足以让模型识别这些瞬时变化并做出反应 。

任务空间窄: 在任务非常单一的情况下,模型只需要保持在已知的物理分布内运行,不需要复杂的在线推理或长期策略调整

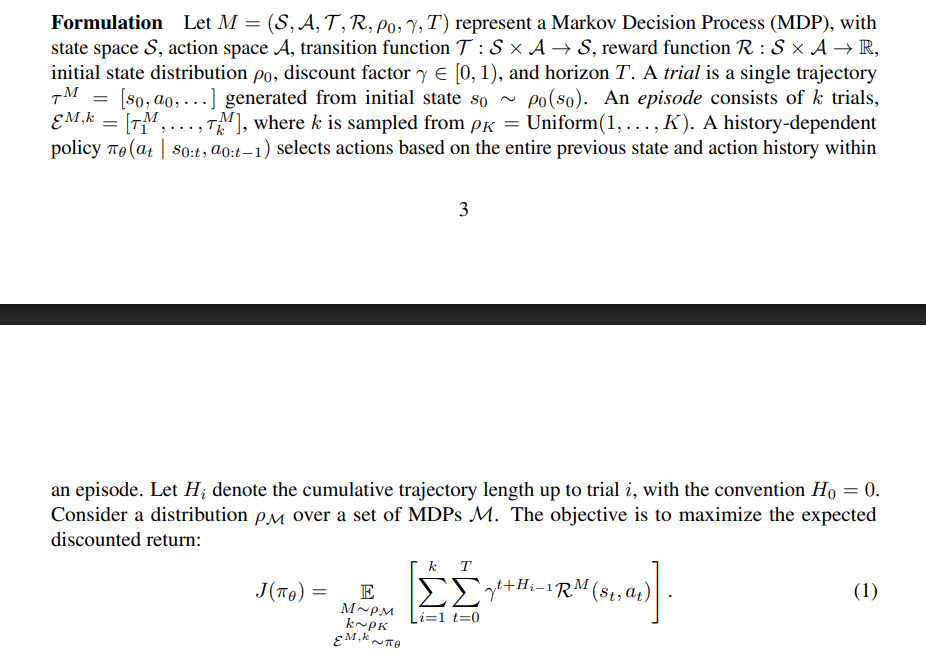

奖励函数

整体目标:最大化期望折扣回报

公式变量拆解

累计奖励计算

跨尝试的折扣因子

为什么说 通过前几次的失败(尝试 1)来换取后几次的成功(尝试 k);奖励不是要 完成 所有k此尝试 才会算出来的吗?第一次和第k次的 policy没变化 吧

“参数”没变,但“行为”变了

用失败换成功

奖励确实是完成所有 k 次尝试后累加算出来的 ,但也正因如此,模型在训练阶段学会了博弈策略:

识别未知的身体: 当模型被部署到一个从未见过的机器人身上时,它最初并不清楚这个身体的运动学参数 。

牺牲局部,换取全局: 如果模型为了追求第 1 次尝试不摔倒而采取极度保守的动作,它可能永远无法收集到足够的动力学反馈 。

训练出的涌现行为: 由于训练的目标是最大化整个 Episode 的总分 ,模型在海量数据训练中“意识到”,利用第 1 次尝试去大胆探索(即使可能导致跌倒或低分),可以获取关键的物理反馈数据 。有了这些数据,它在接下来的第 2 到第 k 次尝试中就能走得非常稳健,从而让总分(1 到 k 的总和)达到最高

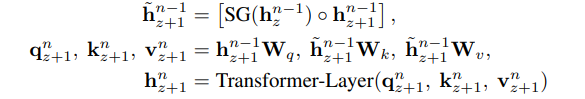

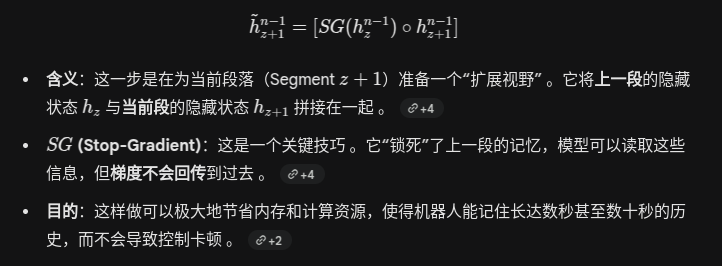

TXL policy

记忆拼接与梯度截断

生成查询、键和值

状态更新

. Let hnz ∈ RL×d denote the hidden states of the n-th Transformer layer for segment σz.

framework

为什么 一次 segment可以跨 trial ,甚至跨 episode? 不应该 一次segment 必然有且只有一个trial的一个时间刻的 observation吗?

Segment :是由 L 个 Token 组成的固定长度序列(例如 L=128) 。所以,一个 Segment 并不是一个点,而是一段“数据块”

为什么segment会跨越trials?

如果 Trial 1 只有 50 步,而 Segment 长度 L=128,那么这一个 Segment 必然会包含 Trial 1 的全部数据 以及 Trial 2 前 78 步的数据。这种“连续性”是 LocoFormer 学习跨尝试自适应的核心——模型必须在同一个上下文窗口里看到“我是怎么摔的”和“我现在该怎么走”,才能学会改进

也就是说,对于这个公式,网络的层数取决于 划分的 segment个数,数据在网络中一层层传递,最终输出时包含了这 好几个 观察 tokens 的信息;而 SG(hn−1z)◦ hz+1n−1 则表示,在当前 第 n-1 层这个网络层,我们去观察他上一次传递时的信息,然后进行拼接;拼接后的向量放在k和v,这样的拼接看似会增大向量长度,但根据交叉注意力的规则,交叉注意力的输出长度只和q有关,所以实际上不会增大向量长度. 我这样的理解对吗?

yes

网络层数是固定的: 网络层数 N 是在模型设计时就定死的一个超参数(例如论文中提到的 6 层)。它不取决于划分了多少个 Segment

极小 3D 归纳偏差 是什么意思

什么是 3D 归纳偏差?

在传统的 3D 视觉算法中,开发者通常会将大量的几何物理规则直接编码进模型中。这些“预设假设”包括:

对极几何(Epipolar Geometry):假设不同视角间的像素对应关系必须落在特定的几何线上。

相机投影模型:预设光线如何通过针孔或镜头投射成 3D 坐标。

三角测量(Triangulation):强制要求模型通过几何交点来计算深度。 这些规则虽然在数学上是完美的,但在面对现实世界中的遮挡、光照变化或低分辨率时,往往显得过于死板

“极小”意味着什么?

VGGT 论文指出,其模型是一个极简的、大型前馈 Transformer 架构。

架构通用化:它不使用针对 3D 任务设计的特殊层(如代价体积 Cost Volumes),而是使用最通用的 Transformer 块。这种架构对数据结构几乎没有假设,除了最基础的序列关系。

数据驱动而非规则驱动:模型不依靠人为定义的几何公式,而是通过在海量的 3D 标注数据上进行训练,让模型自己从数以千万计的样本中“领悟” 3D 空间的物理规律。

灵活性:正因为“偏见”极小,模型不会被错误的几何假设束缚。它可以处理传统优化方法难以应对的极端情况(如极宽基线、稀疏视角)。

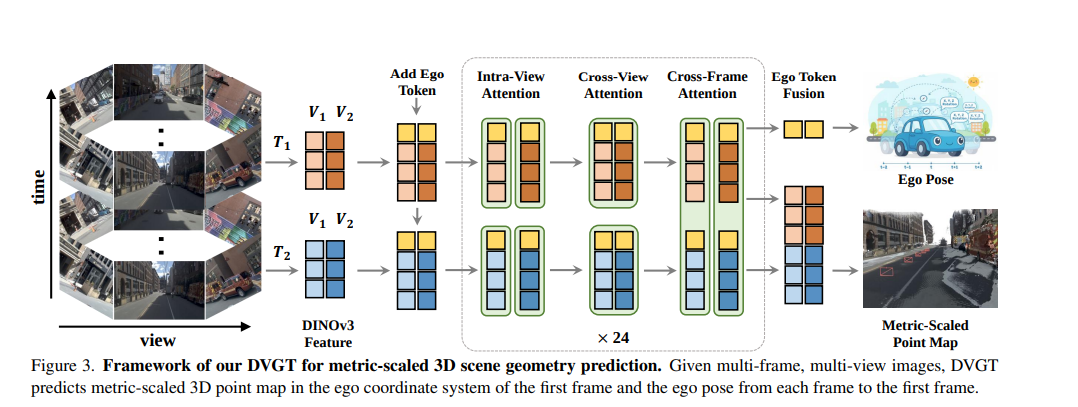

DVGT: Driving Visual Geometry Transformer

https://arxiv.org/pdf/2512.16919

framework

输入与特征提取

空间-时间几何 Transformer

输出头 (Prediction Heads)

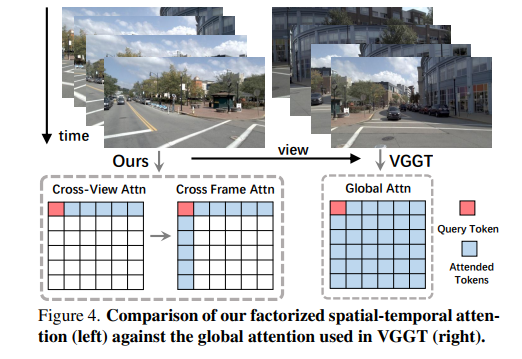

DVGT与VGGT对比

每一个查询 Token(Query Token,红色方块)都会与序列中所有帧、所有视角的全部 Token(蓝色方块)进行交互

虽然信息融合全面,但会产生巨大的计算开销,对于需要高实时性的自动驾驶场景来说是不可行的

文中提到,可以 通过将单目深度预测与投影的稀疏 LiDAR 深度进行对齐来生成“伪标签,这是怎么做到的?

两个核心组件

单目深度预测 (Monocular Depth Prediction):

使用深度学习模型(如文中提到的 MoGe-2 或一般的单目深度模型)从单张 RGB 图像预测深度图 。

特点:它能预测出稠密的(每个像素都有)深度,但通常是相对尺度。模型知道 A 比 B 远,但不知道 A 距离相机到底是 10 米还是 15 米 。

投影的稀疏 LiDAR 深度 (Projected Sparse LiDAR Depth):

LiDAR 传感器可以直接测量物理距离(米制尺度),但它的点云投影到图像上时是非常稀疏的(只有少数像素有点,大部分像素是空的) 。

对齐的目的就是利用 LiDAR 提供的少量准确锚点,去校准单目模型预测出的整张稠密深度图,从而获得一张既稠密又具有真实物理尺度的深度图

对齐的过程

虽然这种方法可以生成伪标签 (Pseudo-labels) 来训练模型,但存在问题

自注意力数据流及其相关代码

对每一轮外层循环 i(aa_block_size=1 时,一轮对应深度上的一层索引):

用当前的

tokens(上一轮 cross-frame 的输出;i=0时是 patch + special token)进入 intra_view → 得到中间结果 ①① 再进入 cross_view(输入已是①,不是初始 token)→ 得到 ②

② 再进入 cross_frame → 得到 ③

下一轮 i+1 的 intra 用的是 ③ 作为输入,以此类推

for i in range(self.aa_block_num):

for attn_type in self.aa_order:

if attn_type == "intra_view":

tokens, intra_view_idx, intra_view_intermediates = self._process_intra_view_attention(

tokens, B, T, V, P, C, intra_view_idx, pos=pos

)

elif attn_type == "cross_view":

tokens, cross_view_idx, cross_view_intermediates = self._process_cross_view_attention(

tokens, B, T, V, P, C, cross_view_idx, pos=pos

)

elif attn_type == "cross_frame":

tokens, cross_frame_idx, cross_frame_intermediates = self._process_cross_frame_attention(

tokens, B, T, V, P, C, cross_frame_idx, pos=pos

)在这一次 _process_intra_view_attention 里,每跑完一个 intra block 就把当时的 tokens reshape 成 (B, T, V, P, C) 并 append 进去

每一轮里,三种注意力各跑 aa_block_size 个 block(默认 1 个),并各自把该步输出存进 intermediates(维度仍是 C)。然后在这一轮末尾做拼接

for j in range(len(intra_view_intermediates)):

# concat intermediates, [B*T*V, P, 3C]

concat_inter = [cross_frame_intermediates[j], cross_view_intermediates[j], intra_view_intermediates[j]]

output_list.append(torch.cat(concat_inter, dim=-1))这样的 「混合得还少」走向「混合得更充分」 ,每一层输出一点到 最终结果,是 自注意力架构的普遍特χ_{0}: Resource-Aware Robust Manipulation via Taming Distributional Inconsistencies征吗

这不是自注意力架构的普遍默认。很多任务(例如分类)只取最后一层的一个 token 或池化结果。

多层特征再融合(例如 DVGT 里 DPT 用

intermediate_layer_idx取多层)是针对密集预测 / 多尺度的常见工程选择,和 FPN、U-Net 跳连、DPT 论文一脉相承:浅层偏细节、深层偏语义,拼在一起往往对深度/几何更好。换成分类头,可能就只用最后一层。

χ_{0}: Resource-Aware Robust Manipulation via Taming Distributional Inconsistencies

https://arxiv.org/abs/2602.09021

核心观点: 资源规模并非唯一决定因素

作者认为,虽然架构演进和资源扩展(如更多的数据、更强的算力)很重要,但机器人执行策略是否鲁棒,其决定性因素在于分布的不一致性。 这种不一致性被作者称为阻碍鲁棒性的“隐藏恶魔”

为了量化分析这一问题,作者将机器人学习管道划分为三个截然不同的分布

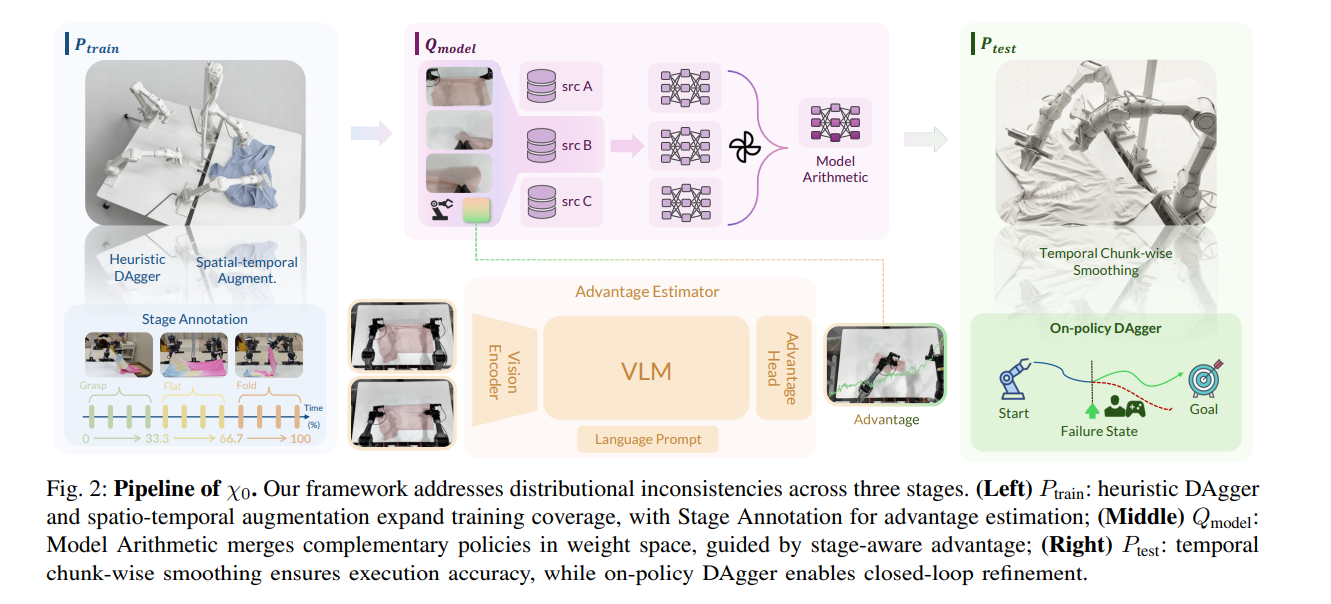

framework

左侧:训练分布 (Ptrain) —— 扩展数据覆盖

中间:模型分布 (Qmodel) —— 权重空间集成

直接从成对的图像输入中预测动作的“优势”值 , 这个 优势值然后会被输入到哪?

转化为“最优性指示器” (Binary Indicator)

输入到“优势加权回归” (Advantage-Weighted Regression)

指引“模型算术” (Model Arithmetic) 的权重优化

右侧:部署分布 (Ptest) —— 确保执行精度

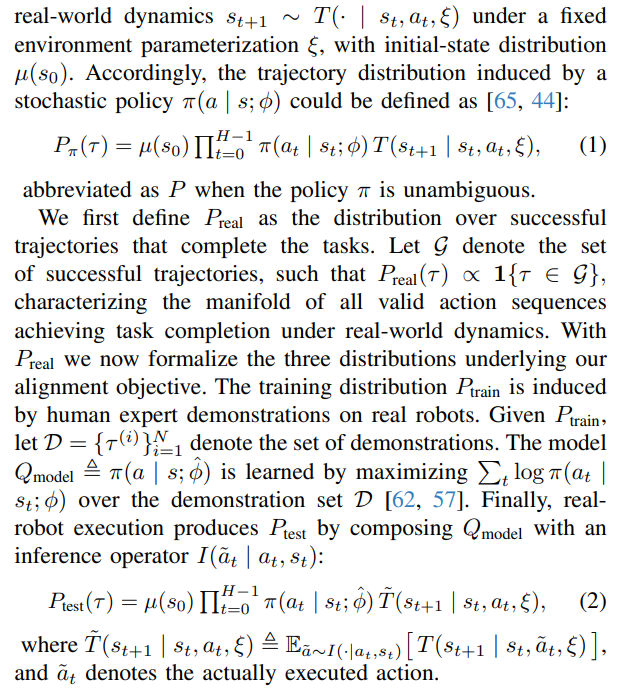

轨迹分布的数学定义

如何理解 Ptest ?

为何会 缺乏对当前“阶段”的精准把握 ? 在马尔科夫链中,s不包含当前的步骤信息吗?

stage_advantage 文档写明:stage_progress_gt 要 Step 0 人工标注 子任务边界,再按段内线性插值写入 parquet,和 observation.state、action 并列——说明 「精准阶段/进度」在管线里是监督信号,不是原始观测自带的字段

标准 LeRobot 样本里是

observation.state、action等;「当前是第几个子任务 / 进度多少」并不是传感器天然就有的通道。kai0 里甚至需要人工标注stage_progress_gt才能训练 advantage(见下),这从工程上说明:原始数据里并没有自动、精准的「阶段」标量给策略用。

混合专家模型 MoE

组成部分

专家 (Experts):

这是一组独立的子网络(通常是前馈神经网络) 。

在训练过程中,不同的专家会逐渐变得“偏科”,专门处理特定类型的数据分布或任务 。

门控网络/路由 (Gating Network / Router):

这是模型的“调度中心” 。

它负责查看输入数据,并计算一个概率分布,决定将该输入发送给哪一个(或哪几个)专家进行处理 。

优势

条件计算 (Conditional Computing):这是 MoE 最显著的特点。虽然模型总参数量可能极大(达到万亿级别),但对于每个输入,只有一小部分专家被激活 。

扩展性:它允许在不显著增加推理计算量的前提下,大幅增加模型的知识容量

为什么 通过线性加权相加各个子模型的参数,可以获得新的模型?有什么数学依据吗?

线性模态连通性 (Linear Mode Connectivity)

同一低损失区域:研究发现,当多个模型从同一个预训练初始化点(如论文中使用的 pi0 或 pi0.5)开始进行微调时,尽管它们在不同的数据子集上训练,但它们最终往往会收敛到损失函数曲面(Loss Landscape)上的同一个“低损失盆地”中 。

凸组合的有效性:在这个共同的“盆地”内,损失曲面在很大程度上是凸的。这意味着,如果你在两个表现良好的模型参数点 theta_1 和 theta_2 之间画一条直线,这条线上的点(即它们的线性组合 theta_{merged} = \alpha\theta_1 + (1-\alpha)\theta_2)通常也会落在低损失区域内,甚至可能比原始点更接近盆地的中心 。

权重空间中的“模型汤” (Model Soups) 理论

chi0 采用的 MA (Model Arithmetic) 策略很大程度上借鉴了“模型汤”的概念 。

减少过拟合:每个子模型由于只在部分数据子集($\mathcal{D}_i$)上训练,可能会对该子集产生特定的过拟合偏差 。

噪声抵消:由于不同子集的采样是随机的,它们的过拟合方向往往是不同的。通过加权平均,这些随机噪声和偏差在参数空间中会相互抵消,而真正有助于完成任务的“共性特征”则会得到保留和增强 。

参数冗余 (Parameter Redundancy):论文提到,大型模型(如视觉语言动作模型 VLA)存在极高的参数冗余 。这使得模型能够像大型语言模型一样,通过简单的算术运算吸收不同子模型的互补能力,而不会产生严重的参数冲突

那为什么 有些 模型 还要用moe架构?

MA 是将所有知识强行“熔炼”到一组参数中。对于机器人操纵(如折叠衣服)这种相对聚焦的任务,参数冗余足以支撑这种融合 。但如果要合并一个顶尖的“代码专家”和一个“创意写作专家”,强行加权平均可能会导致两个领域的精细能力相互干扰,即参数干扰 (Parameter Interference),导致“样样通,样样松”

什么是自回归 (Auto-regression, AR)?

在通用机器学习中,自回归模型是指一个变量的值取决于其自身过去值的模型。在机器人和大型视觉-语言-动作模型 (VLA) 的背景下,它通常指:

序列依赖性:模型在生成输出(如动作序列)时,当前的输出会作为后续输出的参考基础 。

逐步生成:例如,模型预测第 t 步的动作时,会考虑到 t-1 步、 t-2 步的状态或动作轨迹 。

在 VLA 中的应用:像文中提到的 pi_0 或 pi_{0.5} 等基础模型,往往具有这种处理序列数据的能力,从而能理解动作之间的时序关系 。

自回归是一种统计学或机器学习的属性, 可以用 RNN(把 RNN 在 t-1 时刻生成的动作 a_{t-1} 作为输入喂回给 t 时刻),也可以用Transformer

什么是优势加权回归 (Advantage-Weighted Regression, AWR)?

这是一种将强化学习 (RL) 任务转化为监督学习 (SL) 问题的算法。它的核心目标是:在模仿学习的基础上,给那些表现更好的动作更高的关注。

核心原理

不平等对待采样:传统的模仿学习(如行为克隆)平等对待所有专家数据。但 AWR 会根据“优势信号 (Advantage Signal)”对训练样本进行加权 。

优势 (Advantage):表示在当前状态下,执行某个动作比平均水平(价值函数 V(s))好多少 。

学习权重:具有更高“优势”的动作在损失函数中拥有更大的权重。这意味着模型会更强烈地倾向于模仿那些能够显著推动任务进度(高回报)的动作 。

AGILE: Hand-Object Interaction Reconstruction from Video via Agentic Generation

https://arxiv.org/pdf/2602.04672

“neural rendering often yields fragmented, non-simulation-ready geometries” , 什么是神经渲染?

当前最先进的重建方法通常依赖于 NeRF(神经辐射场) 或 3D Gaussian Splatting(3D 高斯泼溅) 等技术 。

多视图依赖:这些方法的基础是“多视图一致性”,即从多个角度观察同一个点来确定其 3D 位置 。

遮挡困境:在手部抓握物体的场景中,手会严重遮挡物体 。由于神经渲染无法“看到”被手遮挡的部分,它很难推断出物体完整的 3D 形状 。

什么是“脆性的运动恢复结构(Brittle Structure-from-Motion, SfM)”?

什么是 sfm 初始化 ?

Structure-from-Motion (SfM) 是一种经典的计算机视觉技术,其核心任务是通过分析 2D 图像序列中特征点的移动,来同时推算出摄像机的运动轨迹(姿态)和物体的 3D 几何结构 。

在手-物交互(HOI)重建中,SfM 通常被用作初始化步骤,为后续的神经网络渲染提供最基础的 3D 参考坐标 。如果这个第一步算错了,后面的模型就像盖在流沙上的大楼,会直接“崩塌” 。

为什么说它是“脆性”的

剧烈运动与模糊(Rapid Motions)

原理:SfM 假设两帧图像之间有足够的重叠和清晰的对应关系。

失效点:在真实的抓取动作中,物体往往移动得很快 。快速运动会导致视频产生运动模糊,使得原本清晰的特征点变得无法识别,导致跟踪链条中断 。

严重遮挡, 纹理匮乏

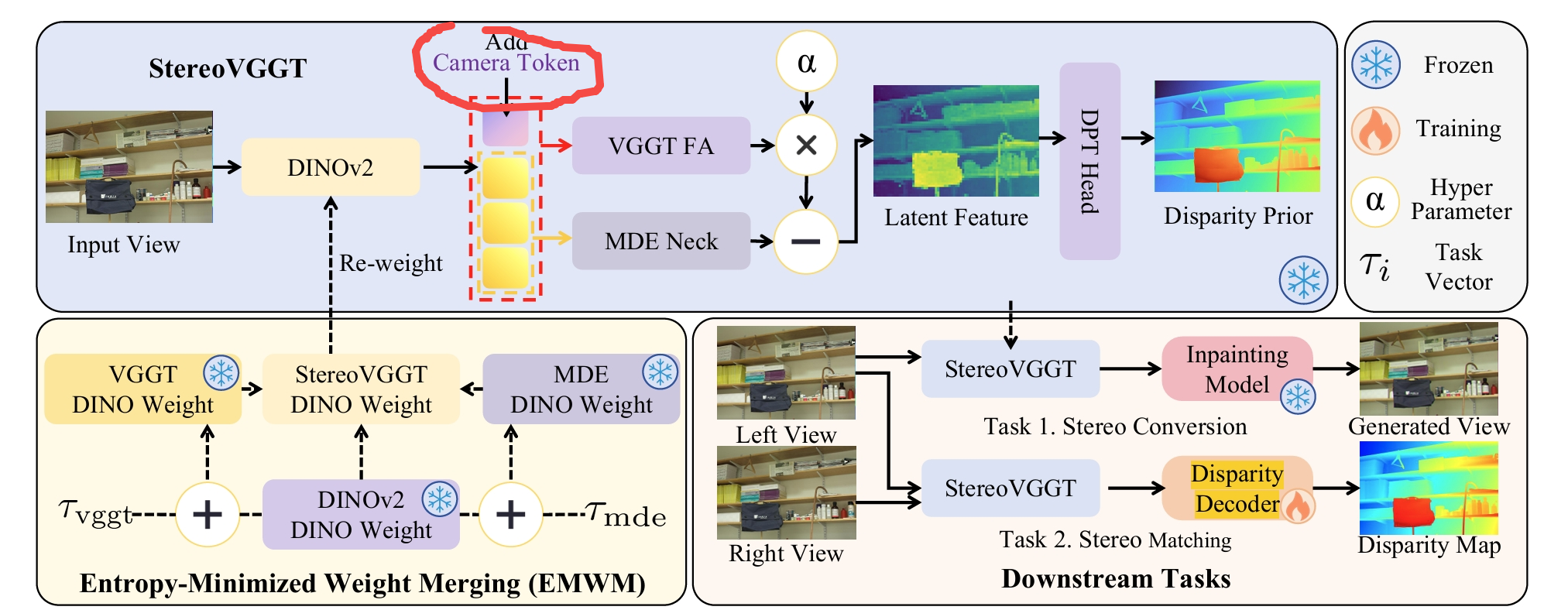

StereoVGGT: A Training-Free Visual Geometry Transformer for Stereo Vision (partial reading)

https://arxiv.org/abs/2603.29368

这里为什么 dino v2 经过 reweight 之后,应该 既有 dino 也有 vggt 的能力了,那为什么 dino v2后还要接 vggt fa?

DINOv2 输出的特征图(Feature Map)虽然还是原始的 Token 序列(空间一致性:DINOv2 输出的特征图通常保留了原始图像的空间结 构),但这些特征里已经包含了对遮挡、边缘和几何深度的特殊关注

DINOv2 输出的是通用的高维视觉特征。VGGT FA 的作用是将这些特征投影(Project)到专门用于几何对齐的空间中

原本 vggt 架构中就包含了 一个 dino, VGGT FA 将这一层拆掉了

vggt 的输出不就是可以包含 深度图的吗?为什么 还要跟 IGEV 这种 disparity decoder 以输出 disparity map?

论文指出,虽然 VGGT 在预训练中学习了丰富的 3D 几何先验(包括相机位姿和深度),但它在特征提取过程中存在严重的空间结构退化和模糊(Structural Degradation) 。

平滑效应:VGGT 倾向于抑制特征细节以减少 3D 重建中的误差积累,这导致物体的边缘轮廓变得模糊 。

不兼容性:这种“平滑”特性与双目立体匹配所需的像素级精确对齐是架构冲突的 。如果直接使用 VGGT 的深度输出,其精度无法达到 SOTA 立体匹配的要求。

StereoVGGT 的做法是将 VGGT 改造为一个强大的 Backbone,为解码器提供既有“相机几何常识”又保留了“空间细节”的特征

论文目前的做法是利用 VGGT 的权重来“重塑” DINO 的特征(通过 EMWM 和双分支颈部) 。VGGT 在这里扮演的是“老师”或“导向”的角色; 优化建议 将 Stereo 的结果或特征 concat 到 DINO 输出上作为 VGGT 的输入,甚至把初步估计的 Pose 也扔进去,把 VGGT 当作一个前向优化模块

原论文做法:把 VGGT 当作产生特征的 Backbone,但 VGGT 提取的特征存在“结构化退化”和模糊问题 。

建议做法:

先让专门的 Stereo 模块(如 IGEV)产生高质量的立体匹配结果 。

将这个结果与 DINO 特征拼接,输入给 VGGT。

此时 VGGT 扮演 Refiner(优化器) 的角色,它利用其对相机位姿(Pose)的隐式理解,去修正 Stereo 结果中不符合几何规律的部分

Scal3R: Scalable Test-Time Training for Large-Scale 3D Reconstruction

https://arxiv.org/pdf/2604.08542

VGGT-Long,如何理解 its alignment is highly sensitive to local accuracy

论文中提到的 VGGT-Long 采用了“分而治之”的策略 。因为它无法一次性处理极长的视频,所以会将视频切分成许多有重叠部分的图像块(Chunks) 。

模型会先独立地重建每一个图像块的 3D 几何结构 。

最后,利用这些块之间重叠的区域,像“拼图”一样把它们旋转、平移、缩放,对齐到一个统一的坐标系中,形成完整的场景 。这个拼接的过程就叫 Alignment

为什么说它对“局部精度”高度敏感?

因为在 VGGT-Long 这种架构中,每个图像块是独立处理的,彼此之间没有信息交流(缺乏全局上下文) 。

误差累积: 如果“图像块 A”预测的相机姿态或深度稍微偏了 1 度,那么在对齐“图像块 B”时,这个微小的偏差就会被放大。

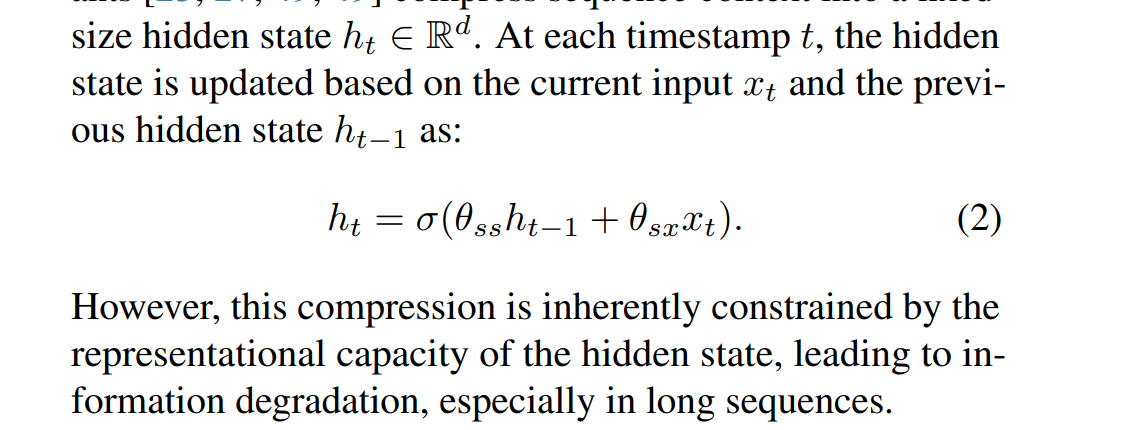

Test-Time Training, TTT

conventional method

传统的 RNN(循环神经网络)将成千上万帧的信息压缩进一个固定大小的向量(Hidden State)里,这就像试图把整本书的内容记在一张小纸条上,必然会导致信息丢失

TTT:它将“纸条”换成了一个小型神经网络的权重 。

由于参数的表达能力远大于单个向量,它能存储的上下文信息量级大大提升,从而能更精准地处理超长视频或公里级的大规模场景重建

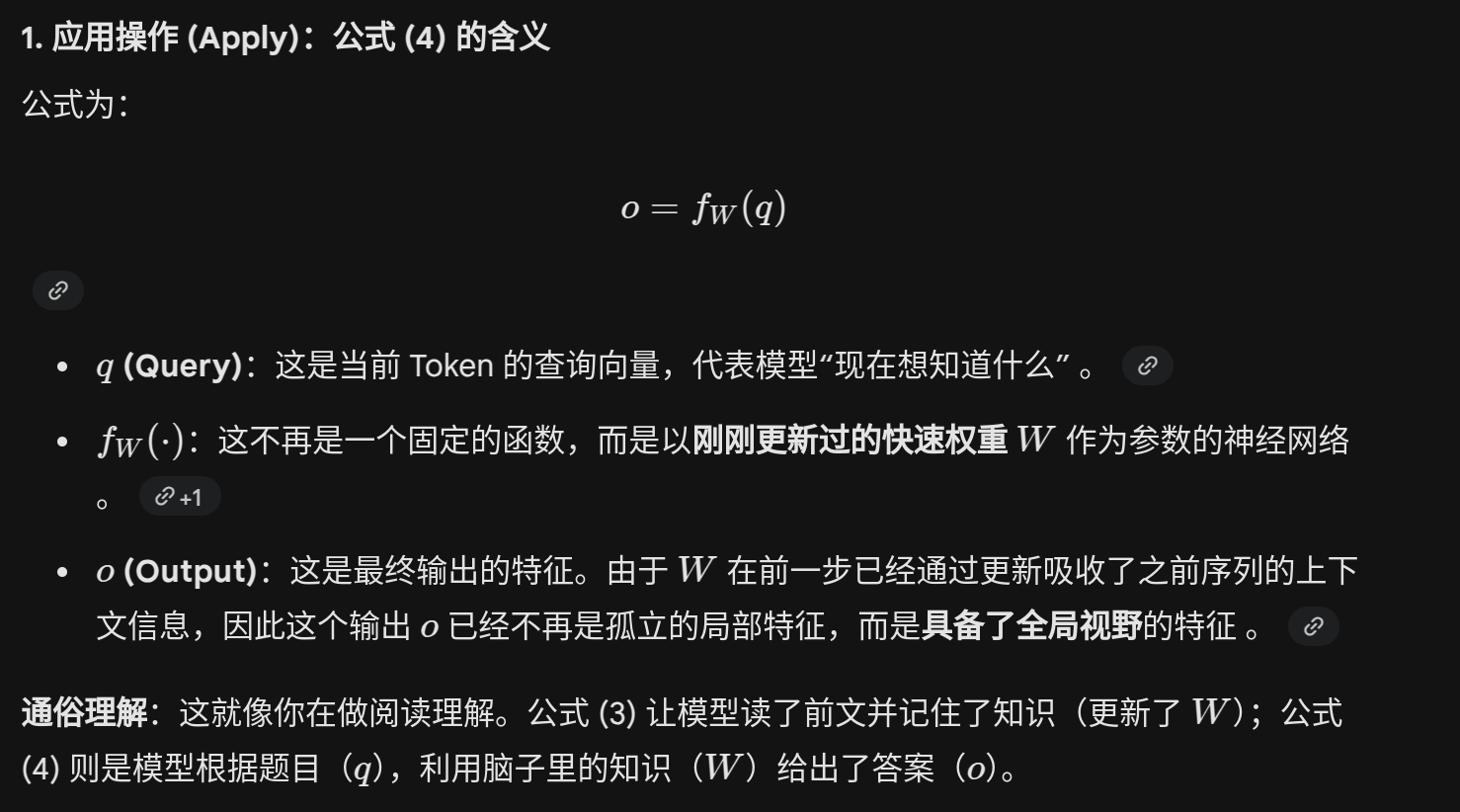

内循环与外循环的训练顺序与关系

训练阶段:端到端同步

内循环更新(前向传播的一部分)模型获取输入图像块。使用当前外循环定义的投影层生成 k 和 v 。执行内循环:通过自监督损失函数 W <-- W计算梯度,并更新快速权重 W 。

注意:这个更新过程是在“前向传播”中完成的,其结果是产生了一组临时进化的 W

前向传播应用

使用这组更新后的 W 来处理查询向量 q,得到增强后的特征输出 o = fW(q) 。模型的主预测头根据 o 预测出相机位姿、深度图和点云

外循环优化(反向传播)

计算最终预测结果与真实标签(GT)之间的 3D 重建总损失 L 。

关键点:梯度会穿过 W 的更新公式,一直回传到投影层和主干网络的初始参数上

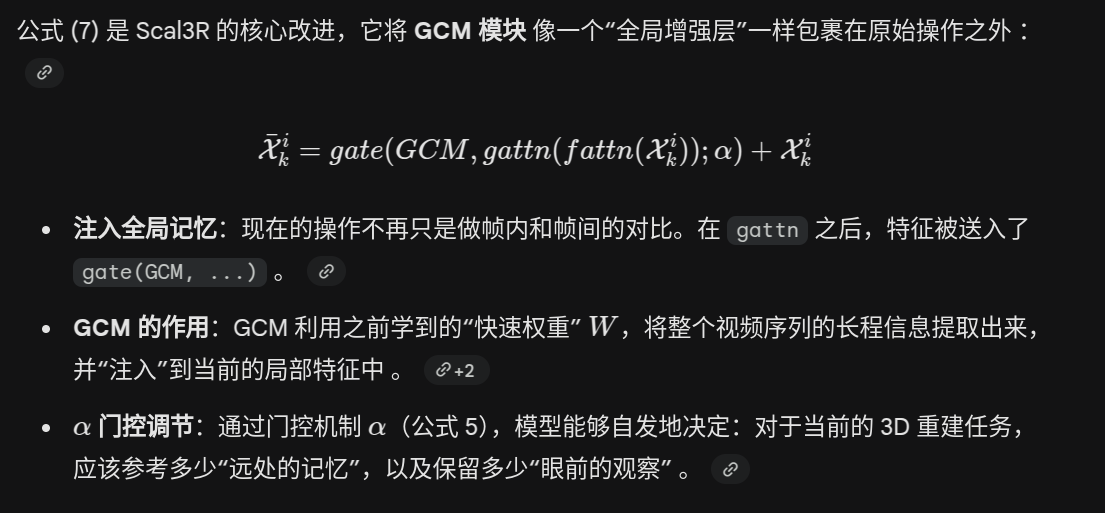

GCM 如何接入 VGGT ?

推理(测试)阶段:只有内循环在动

在实际场景中使用 Scal3R 时:

外循环参数固定:q, k, v 投影矩阵已经练好了,不再改变 。

内循环动态适应:模型边处理视频,边利用公式 (3) 的自监督逻辑实时更新W 。这让模型能针对当前从未见过的公里级场景进行“现场学习”

公式

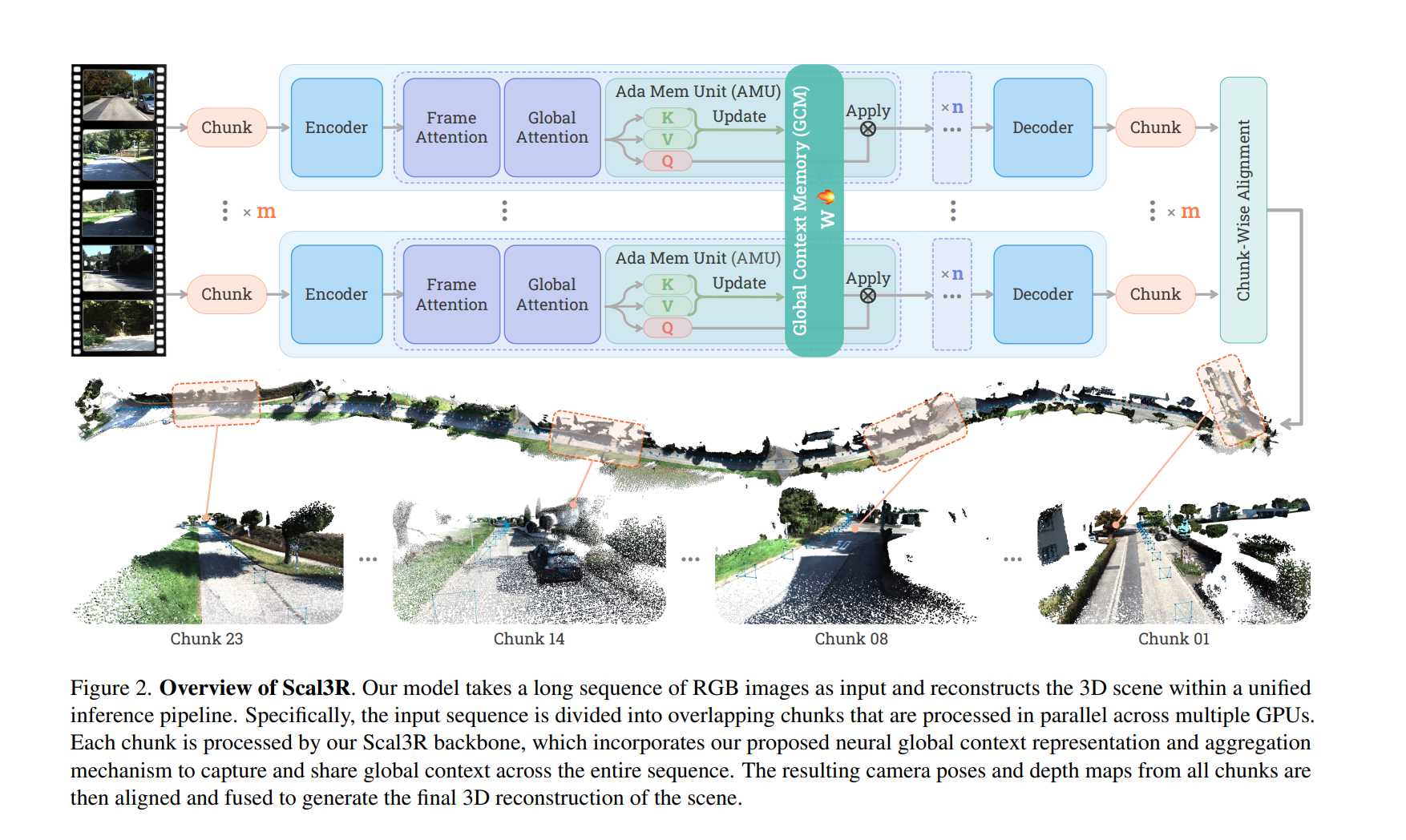

framework

数据的并行分块处理 (Chunking)

特征提取与自适应记忆 (AMU & GCM)

局部 3D 重建 (Decoding)

全局对齐与缝合 (Alignment)

核心公式

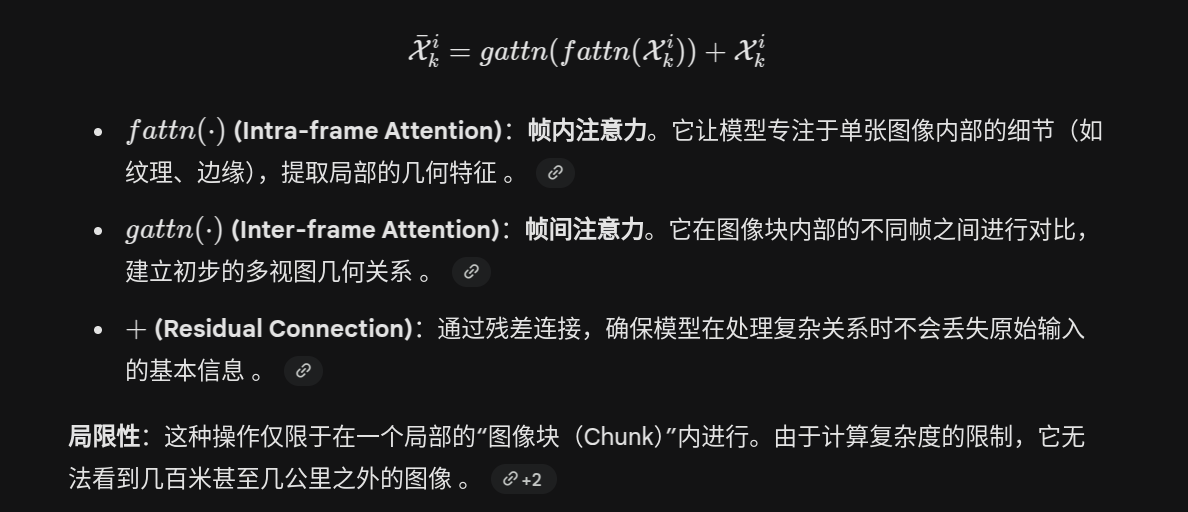

基础交替注意力操作

增强后的全局上下文操作

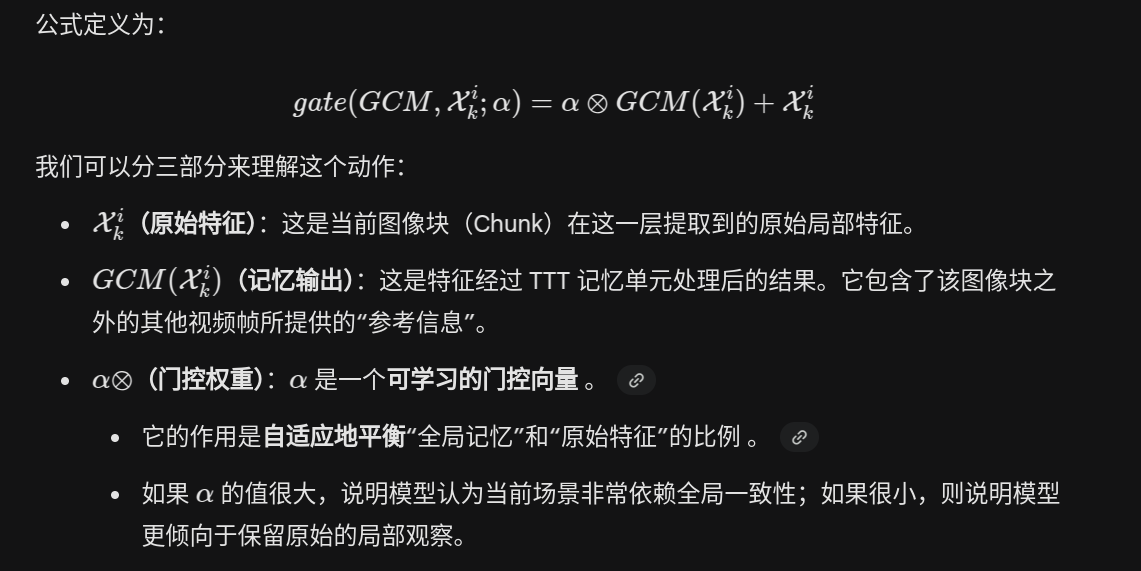

残差门控机制

全局上下文

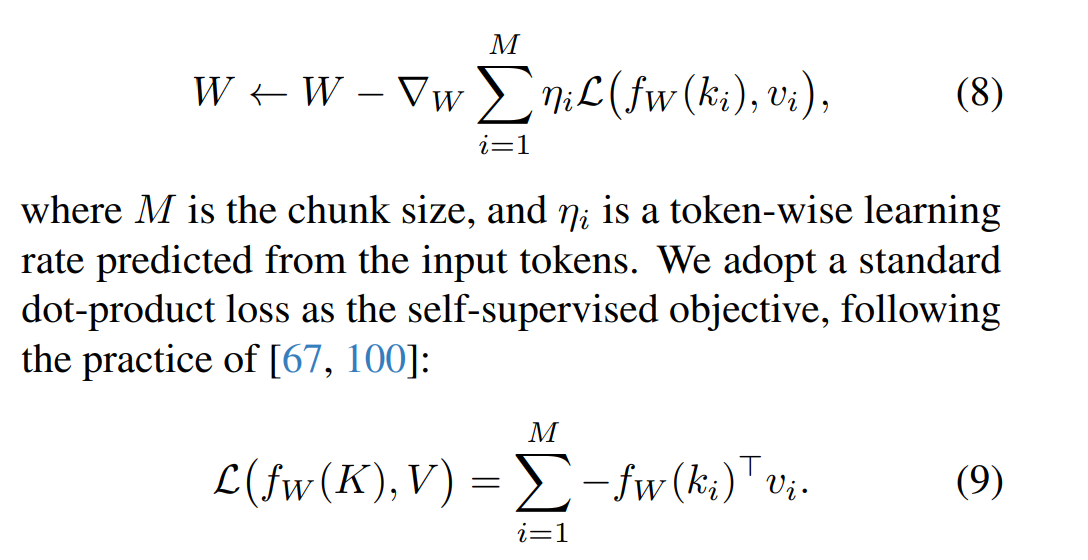

为了提高计算并行度和 GPU 利用率,Scal3R 不再逐帧更新,而是将整个图像块(Chunk)内的所有 Token 作为一个单一的更新单元 。

为什么说 “While the GCM module effectively captures intra-chunk context, it remains confined within individual chunks and lacks the ability to exploit sequence-wide global context.”?好像和framework图片不怎么相符

物理上的隔离:多 GPU 并行

GCS 是那座“桥梁”

WildDet3D Scaling Promptable 3D Detection in the Wild

https://arxiv.org/pdf/2604.08626

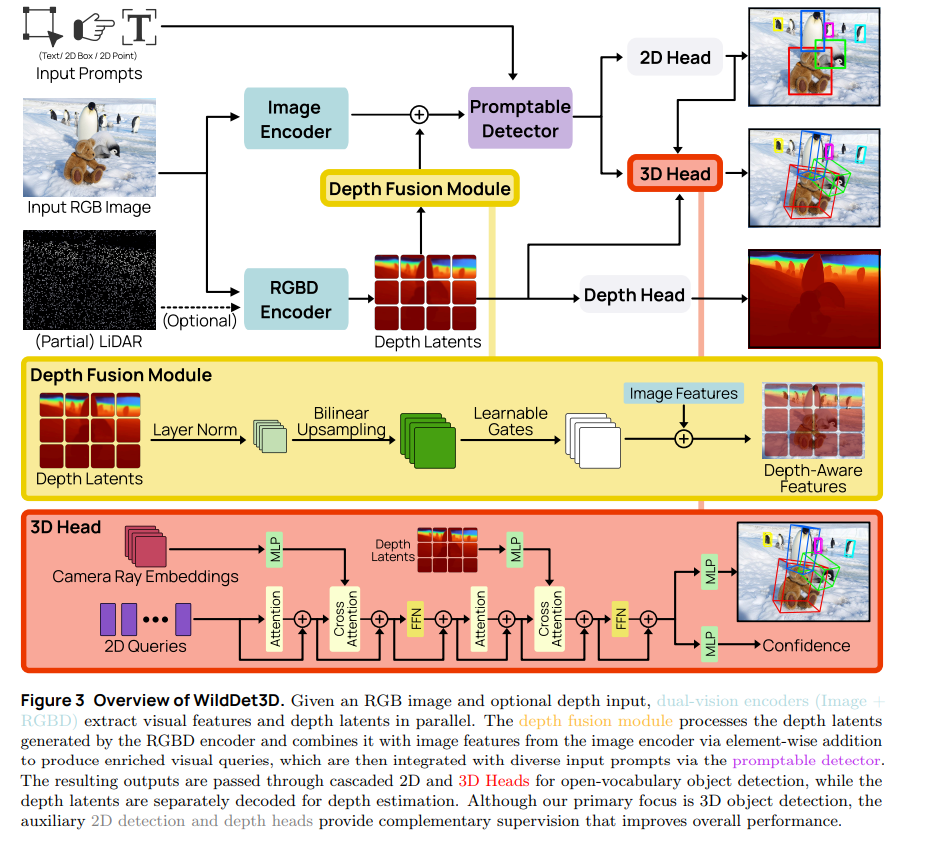

framework

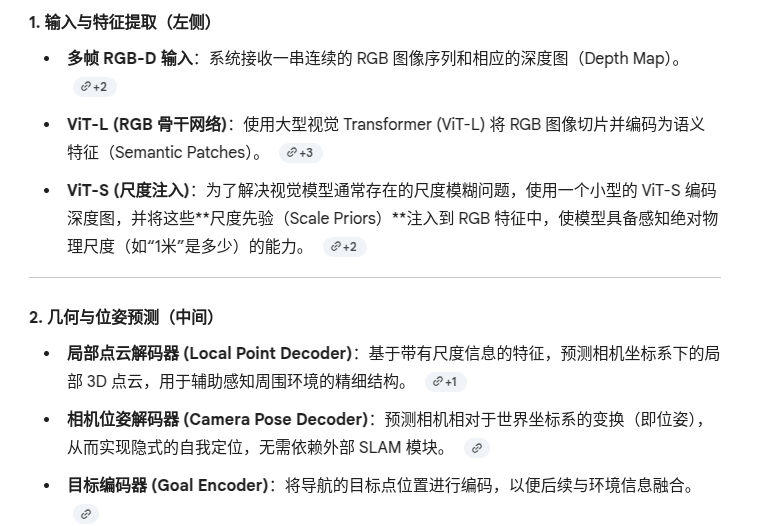

WildDet3D 是一个支持多种提示模态(文本、2D 点、2D 框)并能灵活利用可选深度信息的开放世界单目 3D 目标检测框架

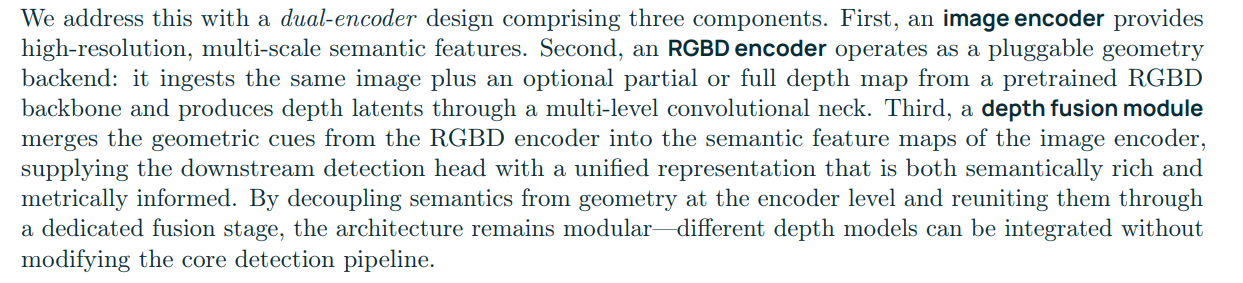

双视觉编码器 (Dual-vision encoders)

位于图的左侧,模型采用了分离的双编码器设计来分别处理视觉和深度信息 :

图像编码器 (Image Encoder): 接收输入的 RGB 图像,负责提取高分辨率、多尺度的视觉语义特征 。

RGBD 编码器 (RGBD Encoder): 作为一个即插即用的几何后端,它接收 RGB 图像以及可选的(Optional)局部或完整深度图(例如来自 LiDAR) 。即使没有深度雷达输入,它也能依靠纯图像生成深度潜在特征(Depth Latents) 。

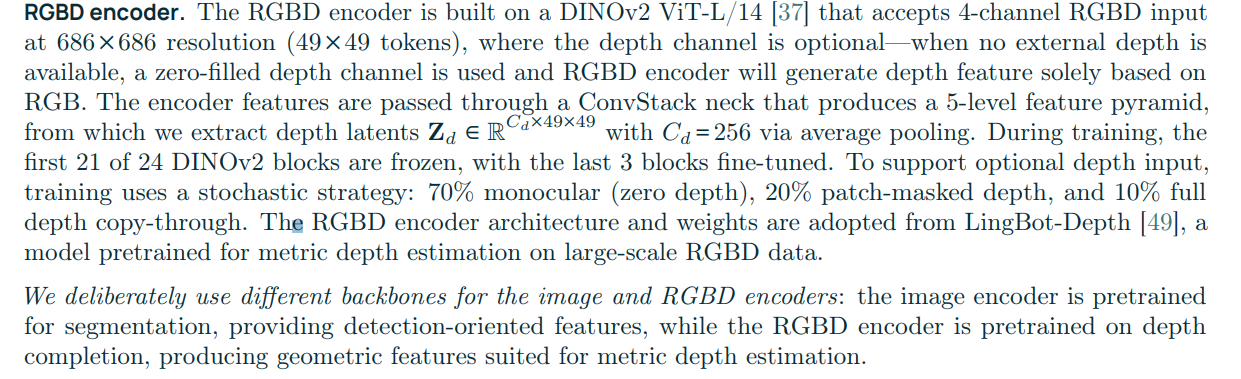

深度融合模块 (Depth Fusion Module)

对应图中黄色的区域。它的作用是将 RGBD 编码器提取出的几何深度特征,完美地融入到图像语义特征中 :

深度特征(Depth Latents)首先经过层归一化(Layer Norm)、双线性上采样(Bilinear Upsampling)对齐分辨率 。

然后通过一个可学习门控(Learnable Gates,即零初始化的 1x1 卷积)与图像特征进行逐元素相加 。

这种设计能在不破坏预训练视觉特征的前提下,生成富含深度信息的特征图(Depth-Aware Features),为后续的 3D 定位提供精确的度量支持 。

可提示检测器 (Promptable Detector)

位于图的中上方。它接收用户输入的提示(可以是文本、2D 框或 2D 点),并将这些提示与前面融合好的深度感知视觉特征结合起来,生成用于目标检测的统一查询向量(2D Queries) 。

3D 检测头 (3D Head)

对应图中红色的区域,这是生成 3D 边界框的核心部件。它负责将平面的 2D 查询“提升”为立体的 3D 预测 :

2D Queries 进入 Transformer 架构后,通过交叉注意力机制(Cross Attention),先后融合了相机射线嵌入(Camera Ray Embeddings)提供的空间方向信息,以及深度特征(Depth Latents)提供的距离信息 。

经过多层特征交互后,通过多层感知机(MLP)预测出物体在三维空间中的中心点、尺寸和旋转角度 。

同时,该模块还会并行预测出一个 3D 置信度得分(Confidence),用于评估 3D 几何估计的准确性 。

辅助检测头 (Auxiliary Heads)

除了主角 3D 检测头,架构的最右侧还展示了 2D 检测头 (2D Head) 和 深度估计头 (Depth Head) 。虽然该系统的首要任务是预测 3D 框,但这两个辅助头能提供互补的监督信号(补充 2D 空间先验知识和全局几何结构),从而大幅提升最终 3D 目标检测的整体性能

LiDAR-based method的描述介绍

优势:“提供直接的几何测量”

(LiDAR-based methods provide direct geometric measurements)

含义:激光雷达通过发射激光束并测量回波时间,能够直接且极其精准地获取物体到传感器的物理距离(深度)

劣势:“生成稀疏的点云,缺乏可靠的高度信息和完整的 6自由度(6-DoF)旋转线索”

(but produce sparse point clouds that lack reliable height information and full 6-DoF rotation cues)

稀疏的点云:LiDAR 扫描出来的世界是由一个个离散的“点”组成的。与相机几百万像素的密集图像相比,点云非常稀疏(尤其是在远处的物体上,可能只落了零星几个点)

缺乏可靠的高度信息:因为点太稀疏,激光束经常会漏扫物体的最顶部或最底部,导致系统很难精准判断物体的确切高度 。

缺乏完整的 6自由度旋转线索:6自由度(6-DoF)指的是物体在三维空间中的位置(X, Y, Z)和姿态(Pitch俯仰、Yaw偏航、Roll翻滚)。因为点云只有形状轮廓,缺乏表面的丰富纹理(比如你看不清车灯朝向、文字正反),所以仅靠几个稀疏的测距点,很难判断一个物体是不是发生了倾斜、侧翻等复杂的旋转姿态 。

3. 局限性:“限制了它们只能应用于具有明确‘直立先验’的类别”

(limiting their applicability to categories with well-defined upright priors)

直立先验 (Upright Priors):指的是一种默认的物理常识——某些物体总是直立在地面上的,不会随意翻滚。比如汽车、行人和自行车。在自动驾驶中,系统可以直接假设这些物体的俯仰角(Pitch)和翻滚角(Roll)都是 0,只需要计算水平偏转角(Yaw)即可。

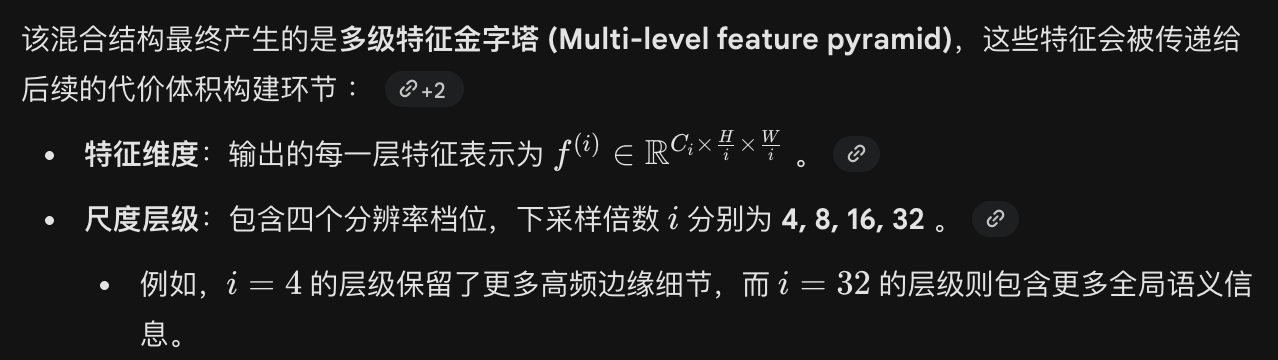

什么是“multi-level convolutional neck”(多层级卷积颈部网络)?

什么是 Multi-level(多层级)?

在现实世界中,物体的大小远近各不相同(比如镜头前的一个大苹果和远处的汽车)。如果模型只在单一的尺度上观察特征,很容易漏掉极大或极小的物体。

多尺度特征金字塔: “多层级”意味着这个颈部网络会输出不同分辨率大小的特征图(Feature Maps)。

各司其职: 高分辨率(大尺寸)的层级保留了更多边缘和几何细节,适合捕捉小物体;低分辨率(小尺寸)的层级则包含了更广的全局上下文信息,适合理解大物体。

这个“multi-level convolutional neck”的具体工作流程是这样的:

预训练的 RGBD 主干网络首先“吃”进图像和深度图,提取出原始的几何特征。

这些原始特征随后被送入这个多层级卷积颈部网络(在论文的具体实现中,它是一个名为 ConvStack 的结构,能生成 5 个层级的特征金字塔)。

该“颈部”将不同尺度的特征进行加工提炼,最终输出高质量的多尺度 “深度潜在特征(Depth Latents)”。

这些提炼好的深度特征,随后就可以被顺畅地送入下一个模块(Depth fusion module),与另一条流水线上的图像语义特征进行无缝融合。

虽然这里没有将 VAE和 DiT一起用,但ViT 确实经常和 VAE(或其变体)结合使用,有以下情形

图像生成领域

痛点:直接让 Transformer 处理高分辨率图像的所有像素,计算量会呈指数级爆炸。

VAE 的作用:在这些模型(如 Latent Diffusion Models 潜扩散模型)中,首先会训练一个强大的 VAE(通常是 AutoencoderKL)。VAE 的编码器负责将高清图像“压缩”成尺寸很小、但包含丰富语义的“隐特征图(Latent space)”。

Layer Normalization and Batch Normalization

深入解析 BN (Batch Normalization)

计算维度:在 Batch(批次)维度上进行计算。

优势:在卷积神经网络(CNN,如 ResNet)中效果极好,能极大加速训练,并自带一点正则化效果(防止过拟合)。

致命弱点:

极度依赖 Batch Size(批次大小)。如果硬件显存不够,每次只能送入 1~2 张图片(Batch Size 极小),算出来的均值和方差就会偏差巨大,导致模型崩溃。

不适合处理变长序列。在自然语言处理(RNN)中,每句话长度不一样,用 BN 很难对齐计算。

深入解析 LN (Layer Normalization)

计算维度:在 Feature/Channel(特征通道)维度上进行计算。

优势:

完全独立于 Batch Size。即便每次只送入 1 张图片(Batch Size = 1),LN 依然能完美计算并发挥作用。

天然契合序列模型和 Transformer。在处理不定长的文本或图像 Patch 时表现极其稳定。

应用场景:目前几乎所有的 Transformer 架构(包括 ViT、GPT、BERT) 的标配都是 LN。

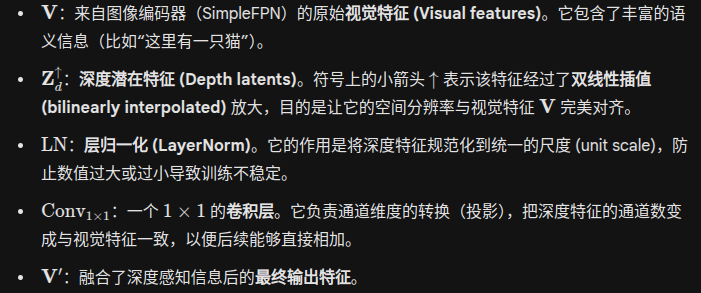

特征融合的核心数学公式 V′ = V + Conv1×1(LN(Zd↑ ))

假设 深度图是 49 49 的 网格,而视觉图 V 是 64 64 的 ;为了相加,会将深度图进行双线性插值,计算周围像素的加权平均值,把 49 49 的深度特征图平滑地“撑大”到 64 * 64

深度特征里那 256 个数字可能特别大(比如 500),而视觉特征里的数字可能很小(比如 0.5)。直接相加会把视觉特征“淹没”掉。

处理:层归一化(LayerNorm)会单独盯住“猫”这个位置的 256 个深度数字,算出它们的平均值和方差,然后强行把它们“压”到一个标准范围内(比如均值为 0,大部分数值在 -3 到 +3 之间)。

1*1Conv : 对于一个像素,可能有256个通道,1*1Conv相当于对其做了一个加权平均,得到一个值,完成 256--> 1 ; 如果想要输出通道有更多,那么再加一些卷积核就行